撰文 | 荣梦岩

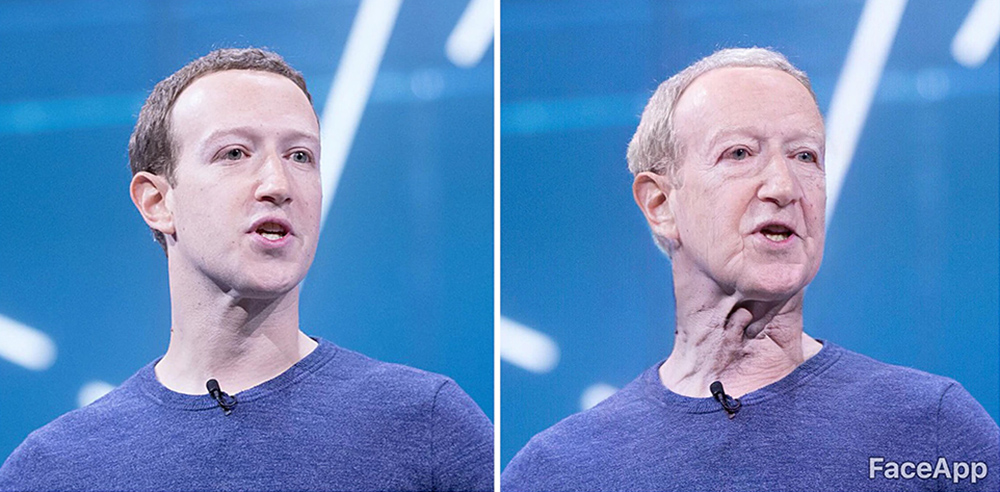

当所有人都尽力把自己的照片“P”美时,一款叫做 FaceApp 的软件却选择让人们“一键变老”。这一功能也确实如 FaceApp 所愿,让它瞬间火遍全网,众多公众人物争相在社交平台分享自己的“18岁”和“80岁”照片。

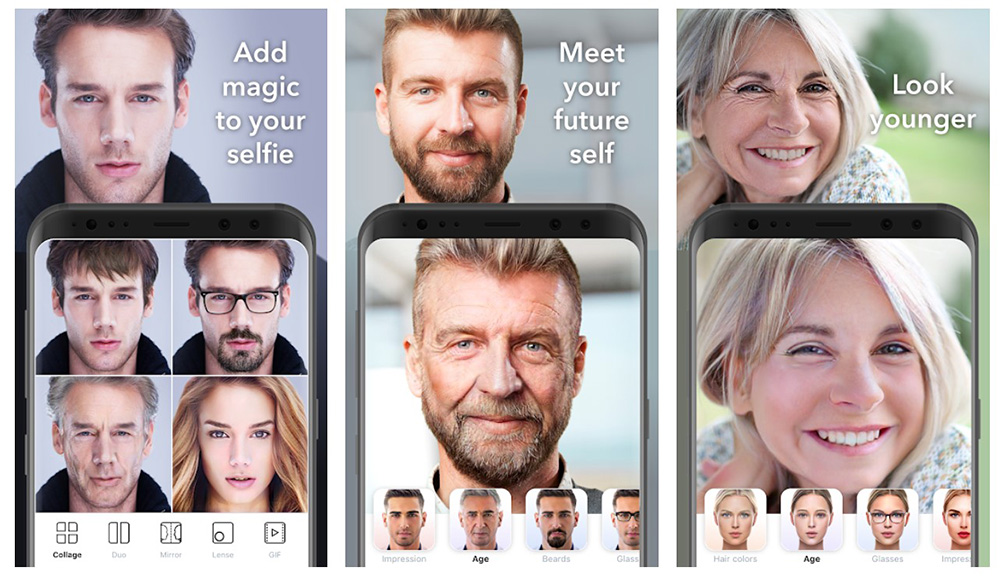

FaceApp 是由俄罗斯公司 Wireless Lab 开发的一款图像软件,用户仅需上传一张照片,即可实现一键变老、一键返老还童、一键变男/变女、一键秃顶......据福布斯报道,这款 App 诞生于2017年,因最近算法大幅提高而爆火。App Annie 的数据显示,7月14日-7月20日短短一周内,安卓 + iOS 平台的总下载量就突破了1000万,预估营收接近300万美金,并且先后在154个国家的 iOS 应用商店登上免费榜 NO.1。

FaceApp 的基本原理是生成式对抗网络(GAN),使用深入的图形计算技术自动识别面部表情中蕴含的信息,然后根据数据库中的其它图像对照片中非重要特征点进行调整,从而获得一张新的面孔。

大师也“P”图

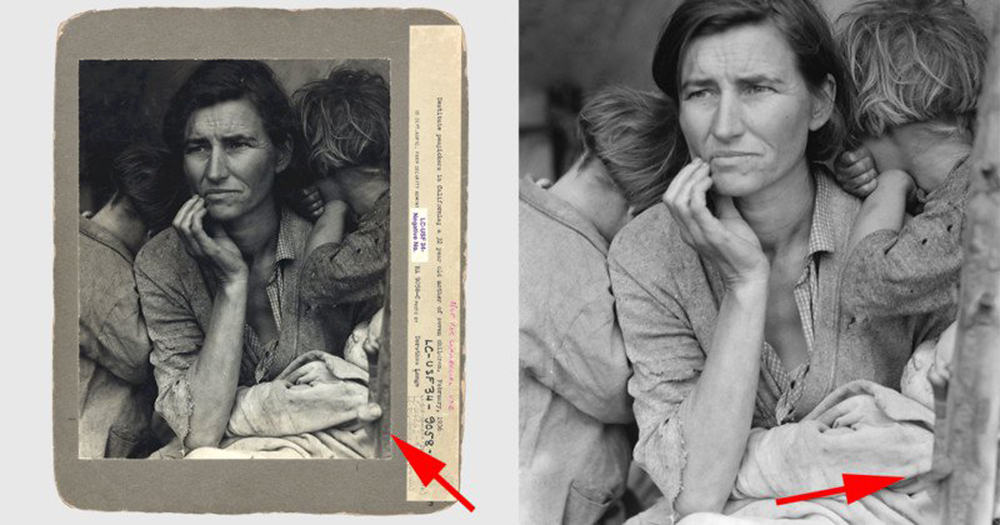

其实,“P”图这一行为由来已久,而且并不只出现在普通人的自拍中,也出现在著名摄影师的作品中。多萝西娅·兰格拍摄的《移民母亲》是美国大萧条时期的经典照片,也是美国历史上最著名的照片之一。就在最近几年中,有人指出这张照片被“PS”过。据《纽约时报》报道,1939年,多萝西娅·兰格指示她的助手编辑照片并抹去了照片中汤普森扶着木头的左手拇指,因为兰格认为左手拇指是这张照片的败笔。现代艺术博物馆策展人 Sarah Meister 在《多萝西娅·兰格:移民母亲》一书中讲到:你可以通过观察母亲的左手拇指来判断,照片是在1939年之前或之后制作的印刷品。

委托兰格拍下这些照片的美国农业安全局(FSA)Roy Stryker 对兰格这种篡改照片的行为感到不满。虽然这种程度的编辑在当时来说并不少见,但是 Roy Stryker 认为,兰格的编辑既影响了照片的真实性,也影响了 FSA 成立这个项目的目的。尽管有这样的争议,《移民母亲》依然成了兰格最具代表性的照片,也成为了美国历史上著名的照片之一。

在多萝西娅·兰格看来,她对照片的改动是服务于画面本身,而在普通人看来,修图通常只是为了让照片中的自己更好看。人们总是把修饰过的图片发到社交网络,以此寻求他人的肯定。另一方面,读图时代和“看脸”时代也让视觉图像交流大行其道,自拍、晒图似乎正在成为某种新型社交方式。因此,P 图也随之变得越来越疯狂,好看的照片已经不能满足人们晒图的需求,好玩儿逐渐成为焦点。

AI 赋予照片更多玩儿法

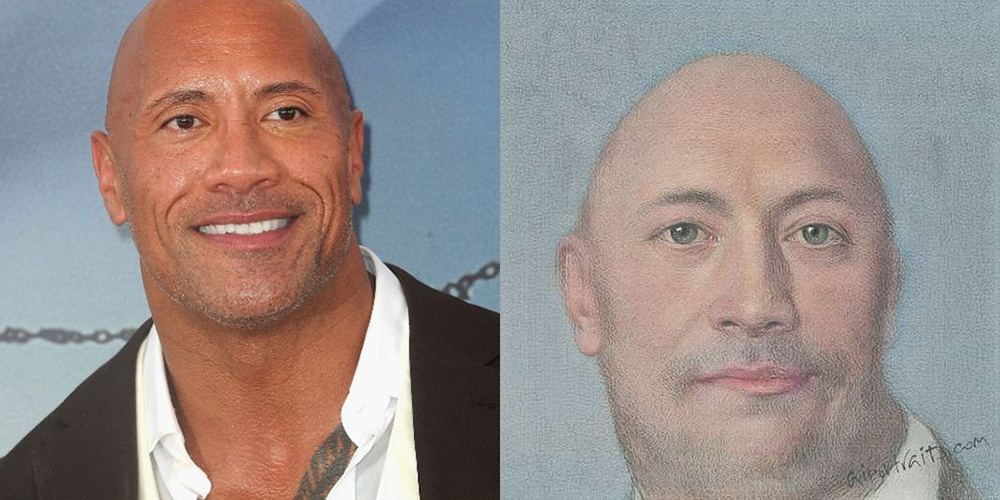

在这个自拍横行的时代,千篇一律的网红脸和相似的45度角仰视……人们不可避免的出现审美疲劳,而 AI 的出现让热衷晒图的人脱离了“变美”这一单一趣味,转而寻觅更有趣的 P 图风格。由麻省理工学院 IBM Watson 人工智能实验室研究人员开发的“AI Portrait Ars”可以将照片解构并重建为文艺复兴时期风格的肖像。研究人员表示,AI 从数万幅“早期文艺复兴时期”和“当代艺术”画作中学习并生成“不同的抽象风格和层次”,照片中的面部线条被完全重新设计,AI 自己可以决定肖像的样式。不少网友发现,被 AI 处理过的照片无一不皮肤变白、鼻梁变高,笑不露齿......研究人员表示,这与文艺复兴时期的绘画风格有关,AI 可以模仿风格,却无法重现照片中的微笑。

今年5月,俄罗斯莫斯科三星人工智能中心(Samsung AI Center)研发出新的“Deep fake”技术可以将人物照片转化成逼真的影片,并为人物添加不同面部动作,例如说话、眨眼、微笑等。该研究团队在专门收集人物说话的短片网站 Vox Celeb 上,取得了7000个样本用于 AI 学习人类说话时的面部变化,AI 掌握主要变化后便能自动套用在其他照片上。三星的这款 AI 技术只需要一张人物照片就能创造出“说话中”的假影像,如果提供更多该人物的照片,所产生的影片也会更加逼真。

争议

FaceApp 的“霸王”协议让用户隐私全无。

FaceApp 在用户协议中这样写道:“您将向 FaceApp 授予永久、不可撤销、非排他性、免版税、全球范围内的、全部付讫的、可转让的二级许可,以使用、复制、修改、改编、发布、翻译、创建衍生作品,分发、公开执行和显示内容以及与您的内容相关的任何名称、用户名或类似内容,且无需向您支付任何费用。”简单来说,一旦用户同意该协议,就意味着 FaceApp 可以以任何方式、任何目的使用用户的照片和姓名。对此,福布斯指出,他们实际上拥有为所欲为的特权。美国民主党全国委员会甚至发出2020年大选预警,警告他们不要使用 FaceApp 。部分政客不仅建议卸载该软件,甚至建议 FBI 介入调查。

而更大的争议还在于人们担心 FaceApp 等类似换脸软件采用的这种 AI 技术遭到滥用。当 AI 不断优化模仿结果,得到更逼真的图像时,它也变成了一件“武器”。不久前,一款主打“一键脱衣”的 App 在社交网络上大火。顾名思义,这款 App 的功能就是“脱去照片中的衣服”,输入一张照片,App 即可借助神经网络技术“脱掉”照片中的衣服,变成一张裸照,而且该软件只针对女性照片。可想而知,只要有了这款软件,任何人都可以制作任意女性的裸照。

这种以假乱真的技术在2017年底曾引发美国社会的广泛讨论,对于普通人来说,这类软件通常只是用来制作一些恶搞小视频。但实际上,这个技术最初的用途是将欧美女明星合成到色情片中。当时,一个名为“DeepFakes”的账号展示了通过 AI 合成的明星色情片,因此获得了极高的关注度。尽管“DeepFakes”很快被封停,但是这种技术却被越来越多的人不断更新和改良,以假乱真的程度越来越高,操作也越来越简单。在华盛顿邮报的一系列报道中,作者表示在 DeepFake 出现一年多之后,这种技术已经变成一种针对女性的武器:这种视频被不成比例的用来针对女性,代表了一种新的可耻的羞辱、骚扰和虐待方式。这些假视频越来越逼真,它们被上传到色情网站上,并且越来越难以识别。 受到这种视频骚扰的女星斯嘉丽·约翰逊(Scarlett Johansson)表示:“那些人攻击我,和攻击你本质上是一样的。每个人都可能成为受害者。互联网就好像一个巨大的黑暗的虫洞,正在将自己吞噬。”除此之外,许多媒体的评论也指出,DeepFake 导致的更大危害是:它开始让曾经被视作最重要证据形式的视频,也变得不那么可信,而且这种制造逼真的假视频的技术有可能被利用在更危险的事情上。

如果说曾经的过度修图让人们的审美出现了偏差,那么现在的 DeepFake 技术则可能将人们置于危险之中。

※ 更多精彩内容与互动分享,请关注微信公众号“乙未光画志”(ID:JMmoment)和界面影像新浪微博

评论(0)