我们先来看一组数据:

中国交通部数据统计, 2014 年中国交通事故死亡人数是 134,000,而在美国,平均每年都有 33,000 人死于高速公路上发生的交通事故。并且这个数字这些年呈现增长的趋势。

还有一个现象:汽车的安全性是在不断升级的。包括国产车在内的高配版本目前都装配了高级辅助驾驶系统,并在逐步完善。

所以今天的问题来了:为什么汽车的安全性能不断提升,交通事故却越来越多呢?

世界卫生组织给了这样一个结论:38% 的交通事故都是由于分心看手机屏幕导致的。在开车这件事上,人能不能同时处理手机上的信息,一直就没有任何人可以有信心的给出肯定的答案,所以目前手机确实是一个分散精力的隐患。

那么这块有没有人尝试解决呢?倒是有不少,而中国的一家硬件公司就是希望通过另一个硬件来“干掉”行车中的手机,让你直接使用他们的产品。

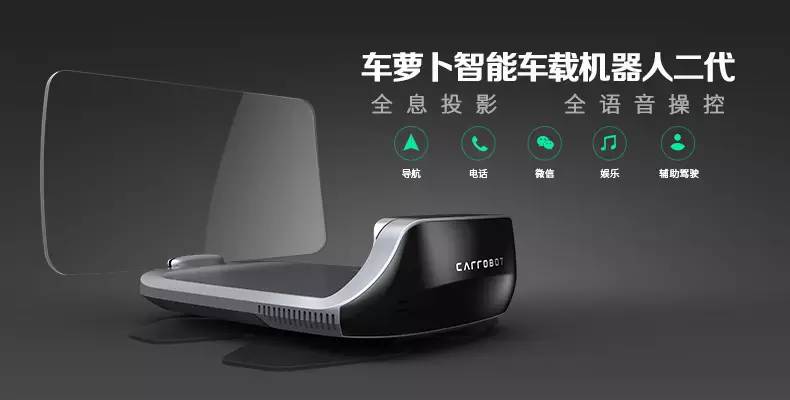

11月1日上午 10 点,车萝卜公司在京东发布了二代HUD(抬头显示屏幕)产品的众筹,最便宜的青春版只需要 799 元,上线半个小时就突破 30 万的众筹目标。

智能出行500miles第一时间连接体验了这个新版“车萝卜”,看看它怎么解决这些问题的?

为什么抬头显示那么重要?

如何在开车的同时处理更多信息,目前前装后装给出了很多解决方案。其中最主流的做法是改造中控台的车机屏幕。但车机屏幕的安装位置天然决定了它并不适合在开车的时候看,而且屏幕越大,隐患就越大,因为很多原本可以盲操作的物理按键都变成了虚拟按键,一旦看了,视线就会严重的偏离路面,带来驾驶的风险。

还有一些方案,比如手势识别,用手势去控制音量大小等等。但是在开车的时候这样做,就意味着,你的手会离开方向盘。

再比如,改造后视镜这块屏,它的弊端在于,后视镜原本的功能是看后方车辆车况的,并且当注意力集中在后视镜区域时,只能用余光看前方路面,依然是危险的。

那么让图像显示在挡风玻璃总可以了吧?目前有一些后装 HUD 的创业公司,做了一层贴在前挡玻璃上 OLED 成像膜,比如 SkyScreen 这款,非常酷炫。

但它还是不够完美——因为成像距离眼睛太近了。视线目标的远近切换也是需要花费时间的,从看远处到近处大约花费 0.6 秒,再看到远处又花费 0.8 秒,如果是在 80 公里/时的状态,这么一错眼珠的工夫,车已经开出 30 米了,为驾驶留下了安全隐患。

所以,理想的 HUD 方案,不应该成像在“屏幕上”,而是成像在“屏幕前”,正如你照镜子时,凝视的并不是镜面,而是镜子的里面。

在宝马的前装方案中,利用图像的多次反射,增加了成像距离,图像显示在车辆前方 2~2.5米的位置,这样驾驶者的视线、图像聚焦点,和前方路面基本上可以重合,效果很好。

但宝马这套前装,造价非常昂贵,如何把这套方案做成一套三千块钱就能够买到后装产品,这就催生出了车萝卜一代机,去年7月成功在京东成功发起众筹后,于 9 月量产上市。

在车萝卜二代中,采用了高亮度的 TFT 液晶屏,对 DLP 光机的显示做了更多的优化,在夜间使用的时候,图像的显示更通透,不会有一层灰色的背景。并且通过光线感应器可以做到亮度自动调节,阳光下看得很清楚,晚上不受其他光源的干扰。

根据智能出行了解,车萝卜的 AR 地图导航功能目前还在研发当中,有望在 2017 年实现。

更聪明的智能语音交互

马斌斌认为,HUD 将会成为未来车里面对用户最重要的一块屏,抬头显示,加上语音操控,可以完美地解决驾驶场景中的用户痛点,让驾驶更加安全。

车萝卜二代在语音操控方面做了很多优化,在萝卜的尊享版里,用了 8 核的 CPU、2G 内存、16G卡,呼唤“萝卜”,可以瞬间的响应,并且实现了更强的降噪能力和更准确的语音识别。

在语音交互系统上,车萝卜与人工智能语音公司思必驰合作,支持多轮互动、打断,在语感上更接近自然语言。

比如,你可以语无伦次,“去火车站……唔,去机场,导航。”系统可以理解到你是要去机场,而不是火车站。

蓝牙连接手机后,说“打电话给 XXX”,如果呼叫的人有多个号码,智能语音会追问“是电信的号,还是移动的号?”或“是北京的,还是 日照的?”

在车萝卜一代中,还不支持局部纠正。如果语音输入一长串电话号码后,发现有误,只能取消重新报。而在车萝卜二代中,可以直接说:“不是 135,是 134”,“不是 8188,是 8128”……语音系统就能理解并作出修改。

连接手机蓝牙后,我们用语音发了一段微信~

美中不足的是,在智能出行的实际体验中,车萝卜二代工程机对女性语音的识别准确度欠佳。联合创始人苗顺平解释,目前对男性语音的识别准确率可以达到 96%,而女性只有 86%。这是由于女性用户只占不到 20%,提供的样本较少,随着样本量的提升,准确率会更高。

开放互联车载硬件

对于大多数车型来说,胎压监测、倒车影像还都不是标配,而通过尊享版的车萝卜,可实时方便地将这些硬件集成到一个平台上操作,比如查看行车记录仪视频、胎压数据、倒车影像、OBD深度检测信息等,全部通过一个 App 操控,如果发现有比较严重的问题,车萝卜会立即发出警报。

通过对接多种硬件,车萝卜可以实现更丰富的功能。比连接行车记录仪后,如果你在开车的时候看到前方风景很美,你可以说“萝卜,拍照”,拍下一张照片,也可以将遥控器的自定义按钮设置为拍照,从此一键拍照。

你也可以通过 AV 视频数据接口,接入倒车影像,车萝卜的抬头显示就可以当做一个倒车影像来看,同时可以兼顾到两边和后方的情况,体验会更好。

马斌斌介绍,未来车萝卜还可以连接红外夜视:“不是把红外夜视直接显示在萝卜的屏幕上,而是在红外夜视里面做图像的识别,提取出对你有危险的障碍物,同时红框标识预警,并语音告诉你,前方行人经过请注意。”

以上这些功能,能否彻底帮你根治掉开车低头的习惯呢?如果还是不能,视线就是控制不住,必须发生偏离,车萝卜的 ADAS 辅助驾驶功能还能强制把你纠正回来。

一句话来说:别低头,王冠会掉,别低头,萝卜会叫。

评论