文|表外表里 张冉冉 黑银柯 周霄

编辑|付晓玲 Reno

数据支持 | 洞见数据研究院

“未来的搜索形式会不断地发生变化,但是它的市场规模之大,恐怕远超很多人的想象。”

李彦宏4年前打出的子弹,时至今日,似乎击中了百度自己。

近期(七月底)B站投资者日上,管理层披露业务最新进展:“B站在搜索这块,有非常大的流量增长空间,今年Q2起,我们会增加搜索广告的尝试。”

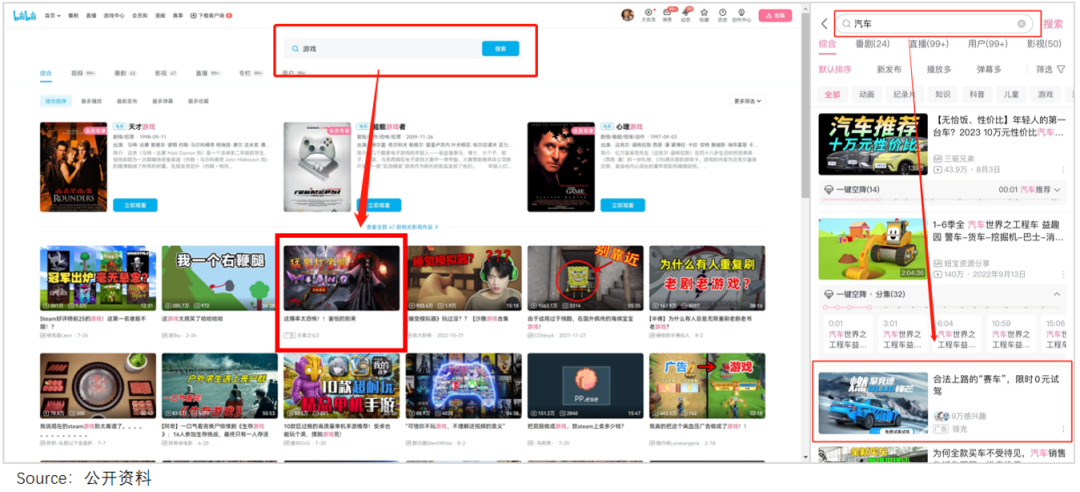

而更早之前,3月初B站开始陆续出现搜索广告。比如搜索“游戏”,搜索结果中的第三个位置展示了游戏广告。

也就是说:B站给出商业化可能的答案,正是视频搜索。

实际上,这不是无源之水,也不是无本之末。行业趋势便是如此,目前视频平台的搜索趋势都愈加明显。抖快均在去年上线搜索广告,Tiktok也在今年3月放开搜索广告。

对于后面的发展,普遍信心十足。如快手2023Q1电话会议也说道:搜索流量快速增长,搜索广告转化效率更高。

巧合的是,这都是最新一个季度发生的转变。这显然离不开过去半年AIGC的大热——行业由TensorFlow时代,发展至Transformer时代。

当下,技术进步的催化,或许打开了视频搜索可能性。过去受制于视频搜索技术、时间效率、成本(人工、硬件)等难题,正在不同程度的一一发生变化。

这自然会打破过去视频行业的商业化天花板。

相比长视频(缺乏有用性)、短视频(纯粹奶头乐)的特征,B站独特的中视频、泛知识、通俗有趣等特征,匹配搜索行为的特定需求,会产生更好的化合效应。

在AIGC时代,视频搜索或将成就B站的“野望”,同时,引发百度的“危机”。

一、AI实现“看视频说话”,视频平台就能坐上金矿

很长的互联网发展周期里,视频搜索都被证明是一条很困难的赛道。

难就难在,视频搜索的整个搜索流程里(输入关键词→解析关键词→召回→结果呈现),召回和结果呈现环节,都存在很大挑战。

以召回环节来说,要实现这点——根据输入的关键词,与数据库内容进行匹配,检索出最符合的视频——不仅要求平台拥有丰富的视频内容池,还要有搜索的精准度。

内容丰富度方面,视频内容因为创作门槛高、时间短等原因,在深度与厚度沉淀上有限。

搜索精准度上,则存在更大的挑战。举个例子,在谷歌上搜索“边牧智商”,呈现的第一个搜索文章,内容里明确有边牧如何高智商的解释字眼。

但如果在YouTube上有一个视频,从能听懂人话、完成指令等各个动态维度,更直观展示了边牧智商很高,可标题、字幕等却没有提及边牧智商等文字标签,这个视频就很难被搜到。

之所以会这样,是因为视频融合了文字、图片等多模态信息,相比纯文章,内容理解要难得多——很难将视频里的狗子,识别成为边牧,更难把边牧的动作,和高智商挂钩。

事实上,2017年Transformer架构被提出之后,多模态模型已不断进化。

比如,先是谷歌由此架构提出了实现图像分类的ViT模型,将Transformer 带到了视觉领域,但该模型仍然只是单图像模态。

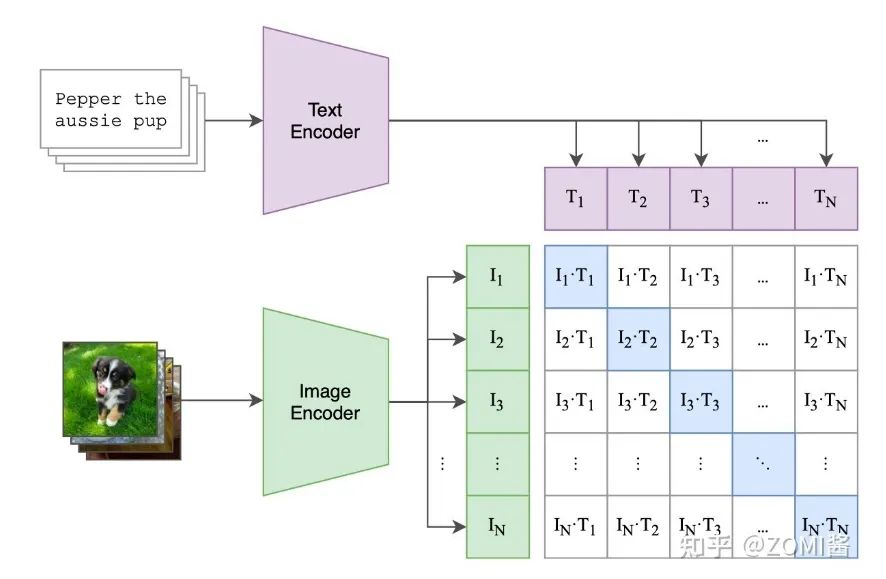

在其之后,OpenAI提出了CLIP模型,可以基于文本对图片进行分类,包括图像处理和文本处理两方面的内容,打破了过去二者泾渭分明的界限,实现多模态。

而且,CLIP在GPT-3的启发下,可以直接全网数据爬虫,一图一文匹配,稍微做筛选即可,几乎不需要人工标注,实现了更高的成本和时间效率。

要知道,过去的视觉模型都是基于人工标注的数据集训练,而一秒视频至少有24帧,短短一分钟的视频就能够提取出1440张图像,把其应用到视频识别上,成本极高。

但尽管CLIP在识别常见物体上表现良好,却无法处理更抽象的任务,比如输出图片中物体的个数等需要一定逻辑思维推理的任务。

也就是说,此时的图像识别,更像人的视网膜原理。但人不光是眼睛看到了当前的情况,大脑还得对情况有相应的反应。

这需要算法具备像大脑一样的语义理解能力,才能够全面理解视频,更好地支撑关键词的召回匹配和排序。

而几个月前发布的GPT-4,让这一问题有了解决的迹象。

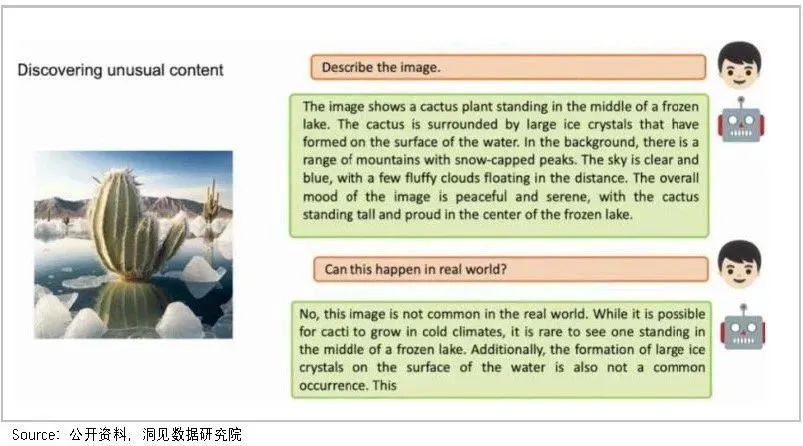

比如在对话中输入下图,GPT-4 的回答是“这是一棵生长在冰冻湖上的仙人掌,它周围长满了巨大的冰晶,远处还有白雪覆盖的山峰”。

继续问“这种景象在现实世界中是否常见”,其解释很少有这样的景象,并给出相应原因。

也就是说,最新的GPT 4已经具备了“看图说话”的能力——不仅做了物体的识别,还可以做很多语义的解读。

以此后推,随着AI模型加速迭代,“看视频说话”也指日可待。当然,反过来也能够实现文本生成视频,降低制作视频的门槛。

但GPT-4这个能力目前只在宣布阶段,还不存在一个完整的多模态大模型,需要一定时间的探索。

况且,多模态大模型要以图像和视频等作为训练数据,文件大小远大于语言类模型,算力成本极高。

比如,百度的文心一言虽然展示了视频生成能力,但因成本较高,现阶段还未对所有用户开放。

而在结果呈现环节,视频也不能像文章一样快速浏览,ctrl+F查找,一个十分钟的视频,可能到后半段才有你要的信息,再加上暂停、记录,三十分钟都搞不定。

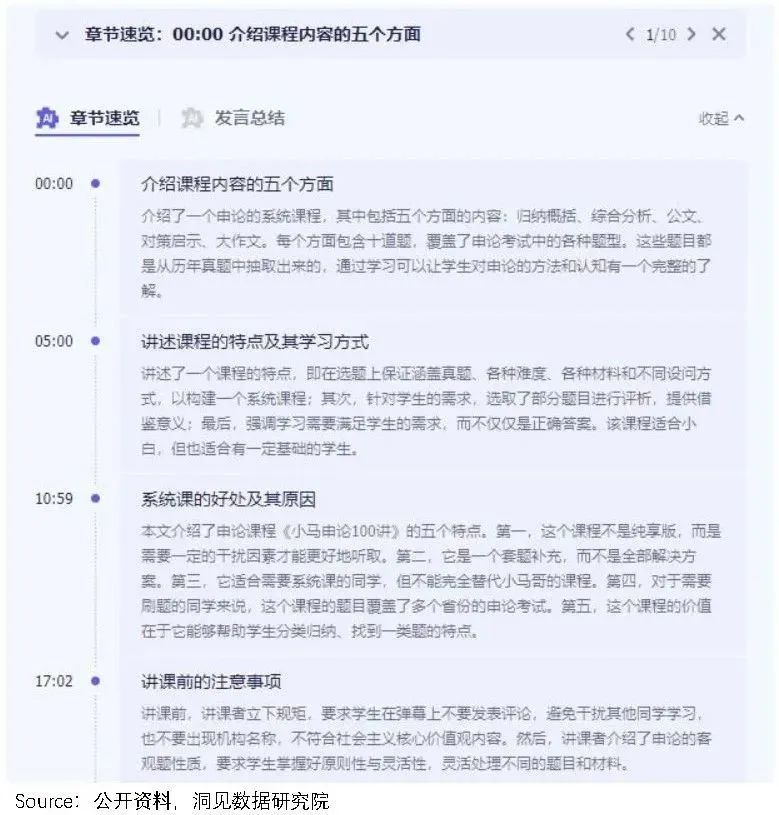

但这个问题,国内已有音视频大模型破解:将视频信息归纳总结,想看哪一段,直接点击章节,就可以跳转到相应的时间段播放。

总的来说,随着视频AI技术的应用,视频搜索在核心的内容丰富度以及搜索精准度,都有望解决。

何况视频本身比文本就更加直观生动,更具吸引力——截止2022年6月,国内网民每天一半的网上娱乐时间都花在短视频平台上。

种种利好叠加,到那时,视频或能代替文本成为搜索的主流。当下在海外,这种苗头已经出现。

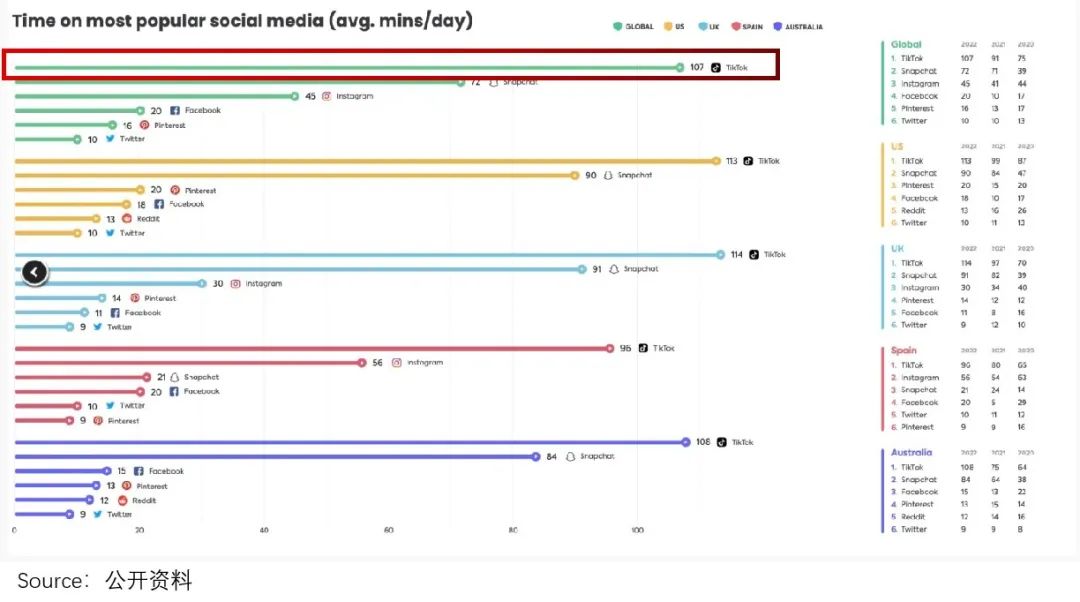

Chowdhury机构调研显示,近40%的年轻人在寻找吃饭的地方时,会在TikTok进行,而不是谷歌搜索。

可以看到,海外年轻人平均每天都要沉浸在TikTok上近两个小时。在这两个小时内,但凡看到有趣的内容,自然触发搜索行为。

这样的情况,让谷歌深感威胁。据透露,谷歌数百名员工被分配到一个被称为“重要的搜索转移”的项目中工作,该项目的内容是让搜索结果显示更多图像和视频。

显然,这对百度来说,也可能是未来会遇到的情况。

但“惊喜”,远不止此。

不同于文字,视频能润物细无声地植入广告,吸引用户点击。最早上线视频搜索广告的youtube曾表示,视频搜索广告带来的点击次数比插播广告,高出近五倍。

不止点击率,广告价格方面也是一样。视频平台本身在算法推荐上就具备优势,再与搜索结合,广告精准度提升,就有人买单。

总的来说,视频搜索场景下,搜索广告的几大驱动因子——流量、加载率、点击率、价格等都有了进一步提高的可能。

这样一来,意味着一旦技术突破,视频搜索可能会重构搜索广告的生态与逻辑,视频平台相当于坐上了金矿。

二、“泼天富贵”终于轮到B站?

B站14周年庆上(6月召开),陈睿当着全国年轻人的面,向中长视频UP主服软称,“要用更真实的播放分钟数去替代播放次数,作为B站视频的主要外显数字。”

那么,为何B站会口风大变呢?

其实,管理层可能不是在讨好中长视频UP主们,而是要迎接自己的时代。

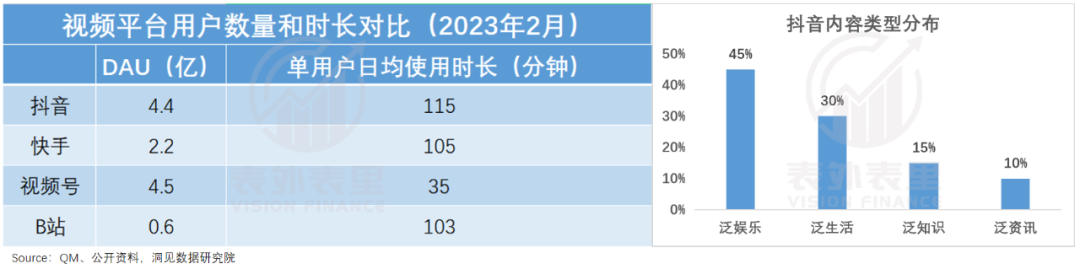

众所周知,一直以来,抖快以沉浸式娱乐内容,在日活、用户时长上,压了视频号、B站等以泛知识内容为主的平台一头。

但视频搜索场景下,两者的处境截然相反。

YouTube相关负责人曾提到:“YouTube上,每周经由关键词搜索而产生的视频浏览量有数十亿次,许多风格偏实用的视频正是通过这种方式被发现的。”

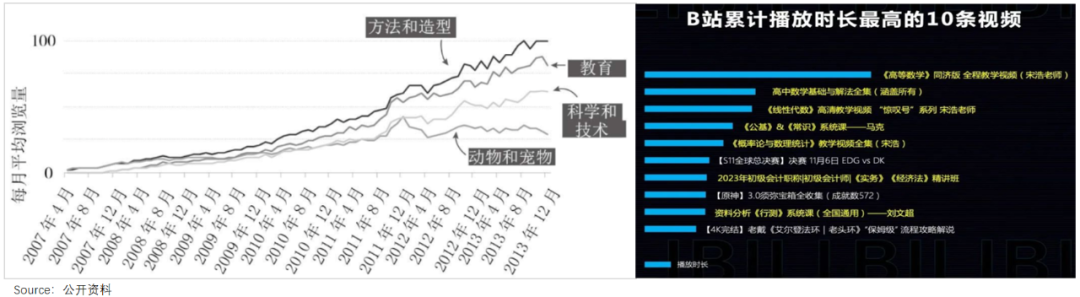

其所说的实用视频正是how to(如何...)类视频——Youtube上每天有数以百万计的搜索关键词当中包含“how to”,用户花在“how to”类视频的时间是“宠物和动物”的10倍。

原因在于:视频搜索是有目的性的,偏知识类的内容,更符合搜索需求。

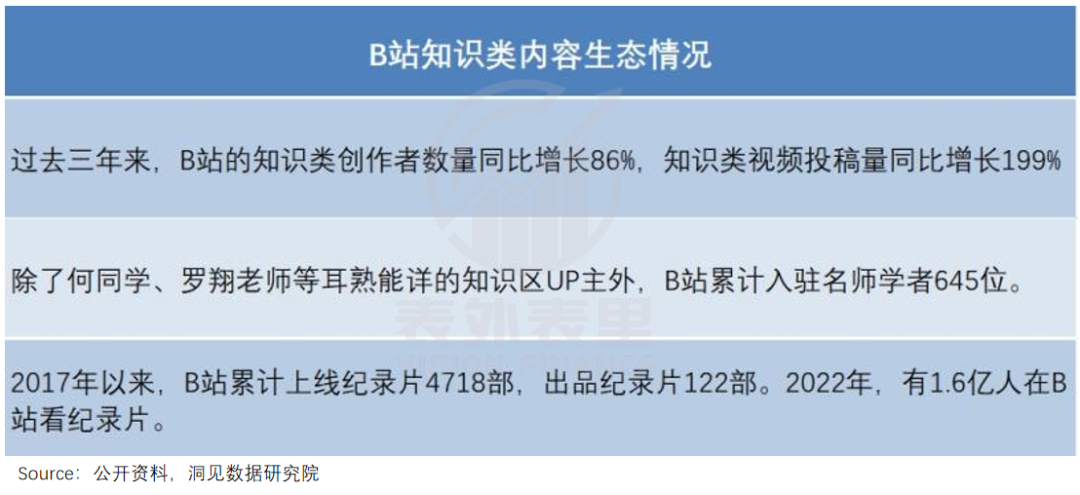

而这也是B站的舒适区,可以看到,截至今年3月份,B站泛知识内容占比41%,“学习网站”的名头无意中越来越夯实。

如此就不难理解,为何“睿帝”低头,调整激励方式。

不过,内容优质只是一方面,视频搜索效率高,还要能提取足够多的关键词。

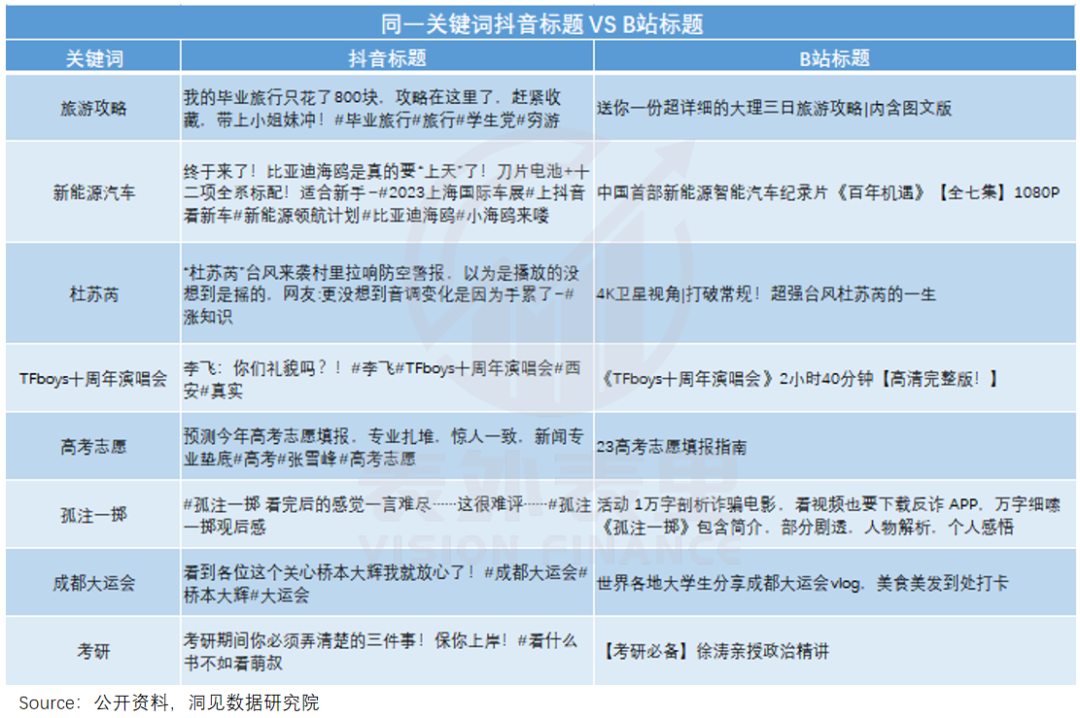

这一点来看,同一关键词分别在抖音、B站搜索到的标题汇总显示:抖快视频标题很长,但大多数采用现成的tag,或者“标题党”类标题;

相比之下,B站的标题简单,可大多具备关键词汇,也更加专业。

搜索内容呈现也是一样,以“山东地震”为例,抖音搜索结果聚焦在“肯定要先跑出去呀”、“啊啊啊啊啊,地震了”等博主本人感受。

B站搜索到的诸如“山东为何突然爆发地震?”等知识科普,创作者更多运用“板块运动”“断裂带”等专业词汇讲解。

也就是说,无论标题、内容,还是时长方面,中视频比短视频都更易提取关键词,与视频搜索更适配。

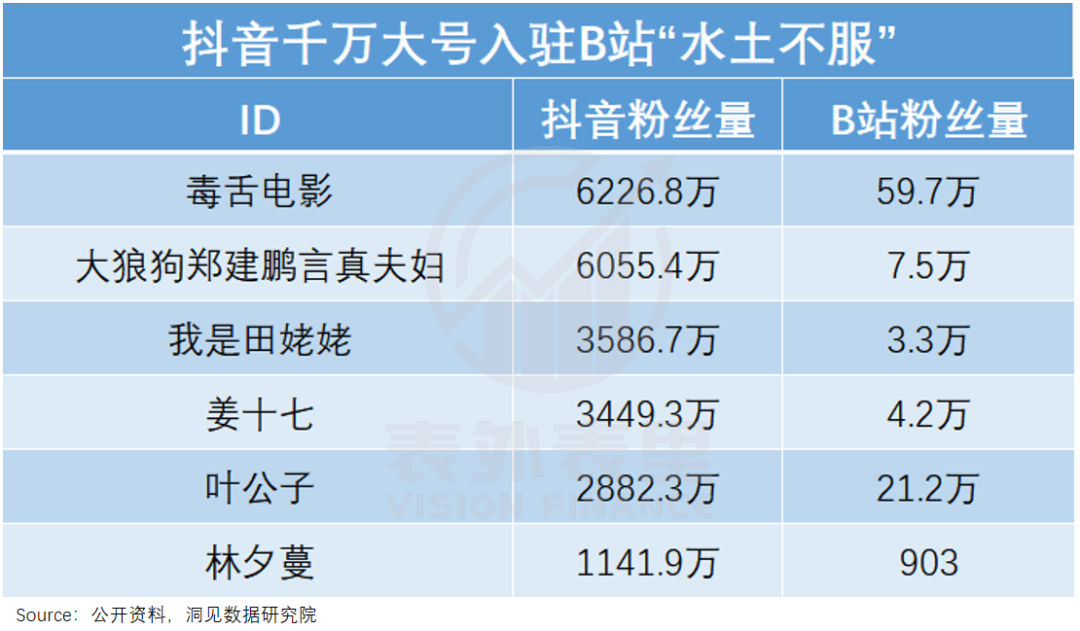

且短视频平台的创作者想转向做中长视频,恐怕也有难度。可以看到,过去一年,不少千万粉丝的抖音创作者入驻B站后,粉丝量表现均不佳。

此外,用户自己搜索所需下,优质的内容能够获得更长的生命周期。

仍以youtube为例,上述所说的How to(如何...)类视频生命周期极长,即使过去很长时间,依然能维持较高的热度,甚至是逆袭式的消费曲线。

B站自己也有这样的畅想,2022Q4电话会议曾提到:B站上面有很多知识类内容,都有很好的历史价值,几年以后大家也都会去看它。ChatGPT的搜索体验,它可以把B站的内容积累的价值,更充分地发挥出来。

这样一来,会激励创作者产出更多优质内容,而不是像当下的Story Mode模式,不断冲击站内的中长视频UP主基本盘。

有了更多的优质内容,就能够扩大搜索流量池,广告主闻利而来,创作者也能获得更多收益,社区生态整个良性循环。

换言之,如果技术实现突破,相比可能让B站陷入“死亡螺旋”的Story Mode模式,视频搜索广告才是良药。(详情请参考《B站能否避开死亡螺旋?》一文)

更何况除了拉动正循环,搜索场景下,平台还掌握着宏观调控的权力。

如YouTube,2020年提升了how-to类内容和高商业化KOL分发权重,当年广告营收达到198亿美元,相比2017年翻了超过3倍。

B站来说,可以将搜索流量分发至更多中腰部up主的推广视频中,一定程度上可以带着up主“共同富裕”。

小结

视频搜索的蓝图,让所有人垂涎。AI大模型加持下,技术正在突破ing,广阔的商业化变现空间,隐隐招手。

而B战尤甚,中视频与视频搜索更适配,这意味着盘活平台的创作者生态,促进新一轮的生态发展。

当然,预期总是美好的,但这一块短中期落地方面,仍存在较大的挑战。

比如,视频训练成本高极高,同时AI联想能力并不可控,可能会导致不恰当关键词投放,让广告主落入负面风险中。

评论