文 | 融中财经

核心观点:

Token工厂的提出,引发了学术界和产业界极大的关注。当前,对AI基础设施的讨论仍沿用“数据中心”“算力中心”这样的传统概念。但是这些概念是无法精准的描述token工厂的。事实上,token工厂正在成为AI世界的基础货币。但围绕它的生产、定价、交易、消耗等内容都处于初期阶段,尚未成型。

Token的生产是token工厂的核心目标,不再是泛泛的计算或存储,而是聚焦于AI模型推理与训练所产生Token。

Token工厂的运营成本中,电力占比可达50-70%,其次是芯片折旧、液冷散热、网络互联和运维人力。与功耗产出对应,单位Token成本与单位功耗产出成反比——功耗产出越高,单位Token成本越低。

现实层面看,token工厂的能源策略对于电力能源的要求极高,传统研究视角将算力和电力视为独立的两个问题,但是token工厂的运行模式,两者必须作为一个耦合系统来研究。电力系统如何配合与供应成为了当前的关注点。

(1)行业定义概念界定

Token工厂(token factory)是指大规模、高效率、低成本生产token为核心目标,通过算—电—热—网深度协同的技术架构,电力、芯片、数据等输入要素转化为标准化智能服务输出(token)的新型基础设施。

Token的生产是token工厂的核心目标,不再是泛泛的计算或存储,而是聚焦于AI模型推理与训练所产生Token。它更强调工业化的规模经济效应,实现高效率、低成本的生产模式。将计算、电力、散热、网络视为一个有机整体进行优化,而非割裂的子系统。对于Token工厂来说,电力、芯片和数据才是他的原材料,产出可计量、可定价、具有交易属性的Token则是它的产出物,也就是为客户提供标准化的智能服务(Token)。

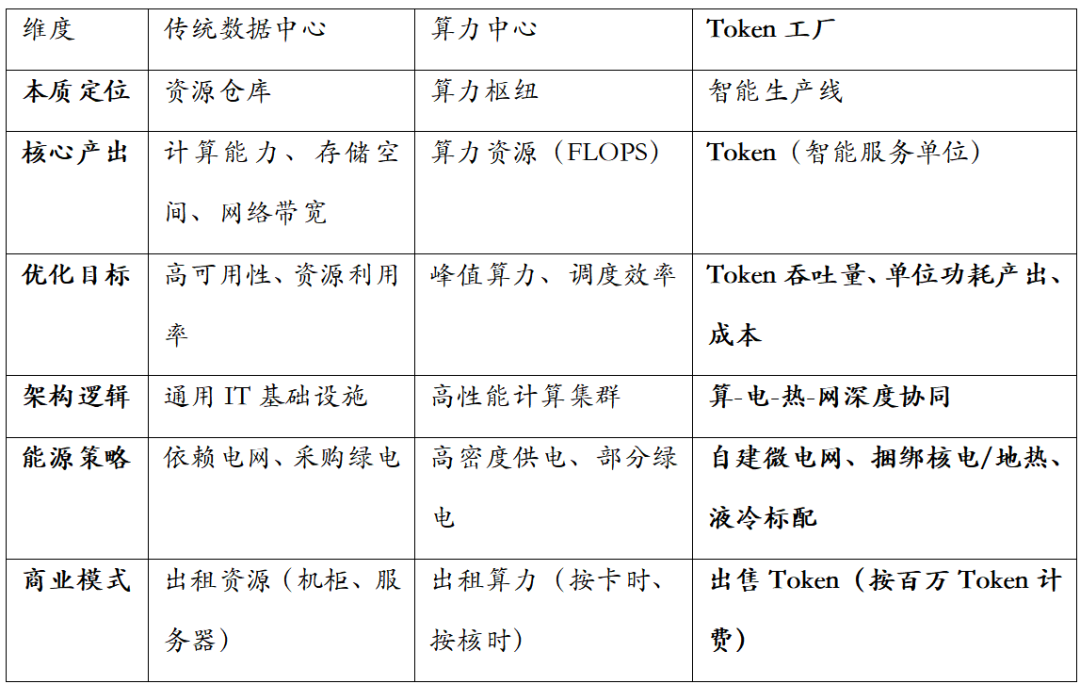

相较于传统的数据中心、算力中心,Token工厂的核心是“生产token”这个工业化过程,而不仅仅是提供计算资源。

具体区别如下:

表格1 Token工厂与传统数据中心、算力中心的对比

数据来源:公开资料,融中研究

(2)市场规模及竞争格局

1)行业市场规模

Token工厂目前还没有官方统计口径,这一概念是英伟达在2026年的GTC大会上正式提出的。因此,融中研究根据Token消耗量、AI推理市场、AI数据中心市场等不同口径来进行市场规模推测。

消耗端:根据国家数据局披露的数据,中国日均Token调用量从2024年初的1000亿增长到2026年3月的140万亿,两年增长超过1000倍。

产业端:2026年3月,阿里云、百度智能云、腾讯云等相继上调AI算力相关产品价格,部分模型Token计费涨幅超过400%。英伟达预测2026-2027年全球AI算力采购订单积压规模将突破1万亿美元。阿里宣布未来三年投入超千亿元用于云和AI硬件基础设施建设。

2)竞争格局

作为2026年3月英伟达GTC大会上正式提出的新概念,token工厂的竞争格局正在快速形成中。英伟达CEO黄仁勋在GTC 2026大会上明确指出,AI竞争的核心已从模型训练转向Token生产效率(即推理)。衡量标准不再是“峰值算力”,而是“每瓦token吞吐量”和“每百万token成本”。

从全球来看,中美走向两条侧重不同的发展道路。美国侧重于前沿突破,驱动力来自资本与顶尖研发的良性循环。目前,英伟达Vera Rubin平台七颗芯片全部投产,从3nm走向1.6nm,从地面延伸至太空,从GPU扩展至LPU。

中国则更重视向深处扎根,驱动力来自国家战略和产业升级的现实需求。应用空间广阔,工业场景和商业链路完整,要优先解决算力如何真正用起来。

Token工厂概念的提出,使得AI行业内的企业更加清晰了自己的行业定位,同时也开始了进一步的行业布局。英伟达的角色不再是单纯的芯片供应商,而是token工厂的全栈方案提供商。芯片层的竞争正在从单性能芯片转向系统解决方案。从云服务和模型层来看,调用量排名前十中,中国模型占据四席并包揽前三名:MiniMax M2.5、阶跃星辰Step 3.5 Flash、DeepSeek V3.2,Kimi K2.5位列第九,中国模型的核心竞争力在于极致性价比——Token价格仅为国外竞品的1/6至1/10。

(3)产业链图谱

Token工厂产业链的传导逻辑是:下游应用爆发,大模型、AI智能体等的大规模应用,使得Token需求激增,从而导致算力开始涨价,上游硬件开始扩产。

表格2 Token工厂产业链梳理

数据来源:公开资料,融中研究

注:电力供应环节因企业较为分散(如核电、绿电、电网调度等),且此前未列出具体代表企业,故暂未纳入表格。如有需要,可补充国家电网、南方电网、中广核等。

(4)影响与意义

Token工厂的出现,标志着AI产业从“模型竞赛”转向“生产竞赛”,价值锚点从模型智能水平转移至Token的生产效率与成本。模型正从稀缺品变为大宗商品,竞争焦点变为“谁生产Token更快、更便宜、更稳定”,AI由此从实验室经济走向工厂经济。同时,能源与算力深度耦合,“算电协同”成为新范式:电力从成本项升级为战略资源,占比高达50-70%,Token工厂通过柔性负载调度、自建微电网甚至捆绑核电,将算力从“云”变为与地理、能源、电网绑定的重资产,彻底改写了数据中心选址与运营逻辑。

全球竞争格局正被重塑,Token成为新型战略商品。中国凭借极致性价比,在Token调用量上已反超美国,形成“Token出海”这一智能服务出口模式,中美分化出自主可控与前沿技术两条路径。经济模式上,Token演变为可计价、可交易的“智能货币”,黄仁勋提出五级定价模型,商业模式从“卖资源”(按卡时)升级为“卖产品”(按Token),2026年集体涨价潮宣告卖方市场来临。垂直整合与重资产化成为巨头战略,Token工厂使AI真正成为千行百业的生产力工具,开启了智能的工业化大生产时代。

(1)生产核心:芯片与集群

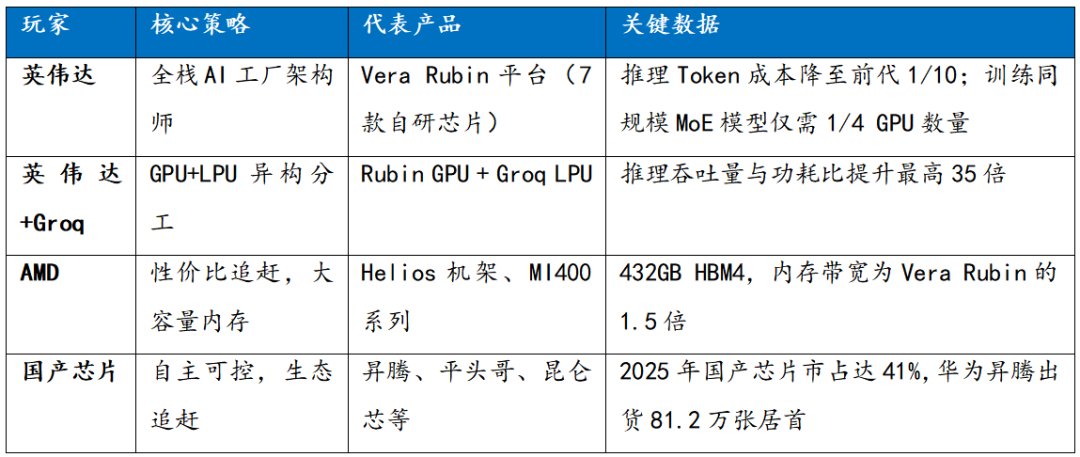

1)芯片

从“单芯片性能竞赛”转向“全栈系统级协同”。芯片不再是孤立元件,而是与互联、存储、网络深度绑定的平台化解决方案。

表格3 关键玩家与策略

数据来源:融中研究

2)集群

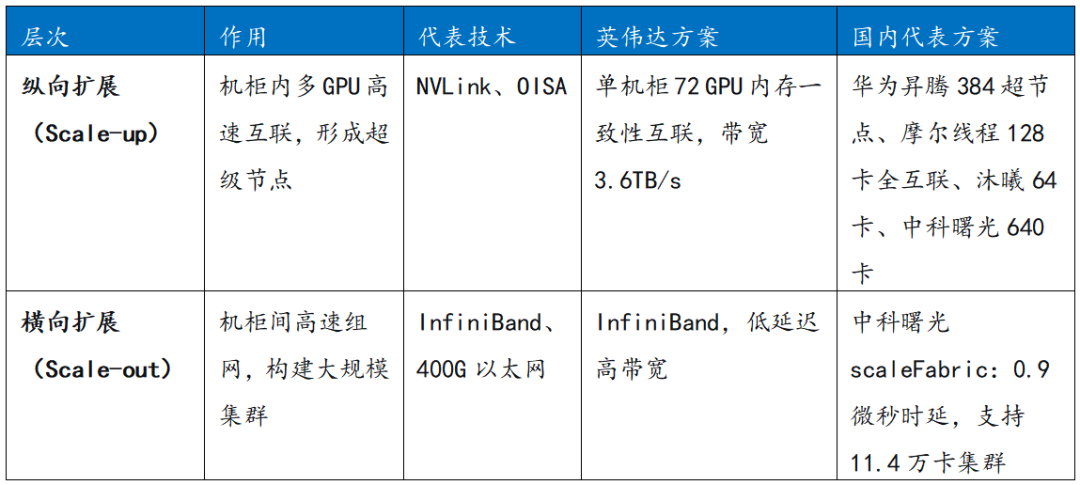

当集群从千卡迈向万卡/十万卡,芯片间通信效率成为整体算力利用率的关键瓶颈。供电、散热、网络拓扑、与电网协同共同决定系统上限。

表格4 集群架构分层

数据来源:融中研究

(2)生产流程

1)输入阶段

Token工厂的输入主要包括三类核心资源:电力、数据、算力基础设施。

表格5 Token工厂的输入

数据来源:融中研究

输入环节的竞争已从“单纯堆砌算力”升级为“算-电-热-网”四位一体的资源整合能力。谁能以更低成本获得稳定电力和高质量数据,谁就占据Token生产的成本优势。

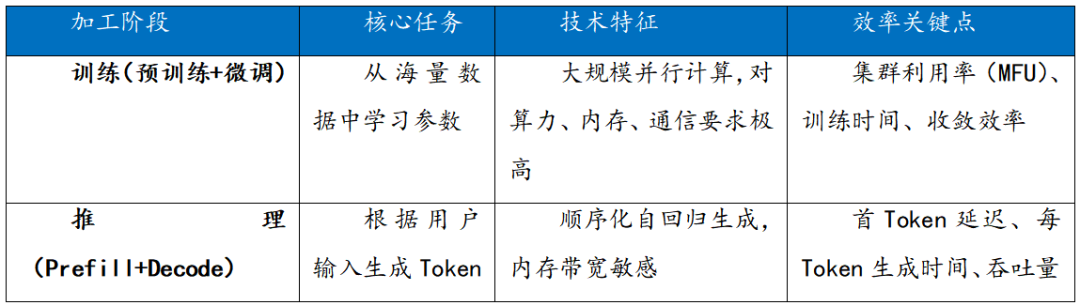

2)加工阶段

加工环节是将输入转化为Token的核心过程,分为训练和推理两大阶段,目前重心正从训练向推理迁移。

表格6 Token的加工环节

数据来源:融中研究

最新架构趋势:

Prefill-Decode分离:英伟达将推理拆分为预填充(GPU负责)和解码(Groq LPU负责),延迟降至0.1毫秒以下,性能提升35倍。

MoE(混合专家模型):仅激活部分参数,大幅降低推理成本。DeepSeek等模型已广泛应用。

投机解码:用小模型快速生成候选Token,大模型并行验证,显著提升推理速度。

加工环节正从“通用计算”走向“场景化分工”。不同模型架构、不同任务类型需要定制化的计算流水线,单一芯片难以包揽全局。

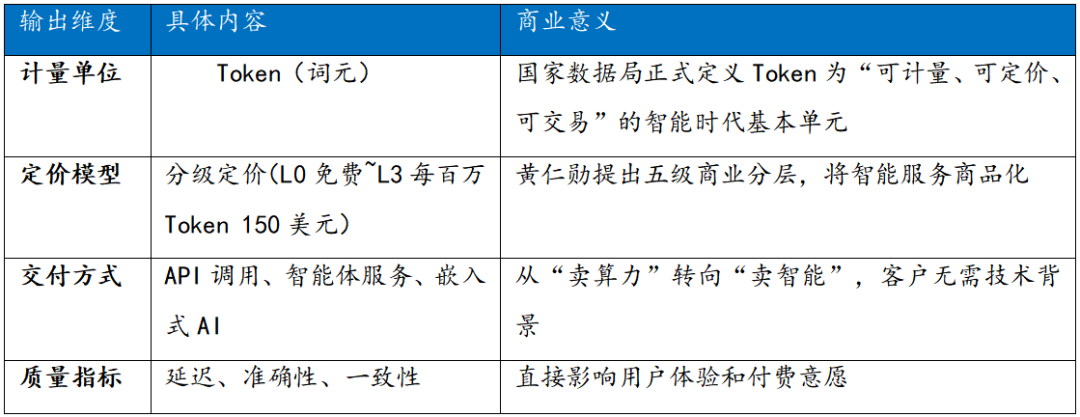

3)输出阶段

输出环节是将加工产生的Token封装为可交付、可计价的标准化产品,并通过API或应用层送达用户。

表格7 Token的输出环节

数据来源:融中研究

输出环节的本质是将无形的“智能”转化为可交易的商品。Token作为标准化计量单位,使AI服务能够像水电一样按需付费,极大地降低了应用门槛。

(3)核心生产效率指标

Token工厂的核心生产效率指标是衡量其竞争力的关键标尺。与传统数据中心看重资源利用率(如CPU利用率、存储利用率)不同,Token工厂的价值产出完全围绕“Token”展开——评价标准已从“拥有多少芯片”转变为“每瓦能耗能产出多少高质量Token”。

1)单位功耗产出

核心指标定义:Tokens per second per watt(每秒每瓦产出的Token数),或更宏观的Tokens per second per megawatt(每兆瓦每秒产出的Token数)。这一指标直接反映了Token工厂将电力转化为智能产品的核心生产效率。

背景与意义:AI数据中心的能耗正以惊人的速度攀升,供电能力、散热可持续性、网络拓扑效率乃至与公共电网的协同能力,开始共同决定整个系统的上限。因此,“每瓦Token产出效率(Token per Watt)”正取代传统的峰值算力与单卡性能,成为新的核心KPI。这意味着评价对象已经从“芯片”转向“系统”——供电、冷却、网络、调度乃至建筑交付周期,都会被纳入同一个经济模型进行统一优化。

提升单位功耗产出的核心路径已从芯片优化扩展到“算-电-热-网”四位一体的协同优化。英伟达在GTC 2026上推出了Vera Rubin DSX AI Factory参考设计,其核心目标就是实现“每瓦最大Token产出”。该参考设计覆盖计算、网络与存储,并配套开放、模块化、可组合的软件栈,将集群硬件与供电、冷却系统联动起来,从而在整体层面获取更高的Token per watt。

2)单位成本产出

核心指标定义:Cost per million tokens(每百万Token的成本),以及Token吞吐量带来的每GPU每秒Token数(TPS per GPU)所对应的总拥有成本(TCO)。它直接决定了Token工厂的盈利能力和市场竞争力。

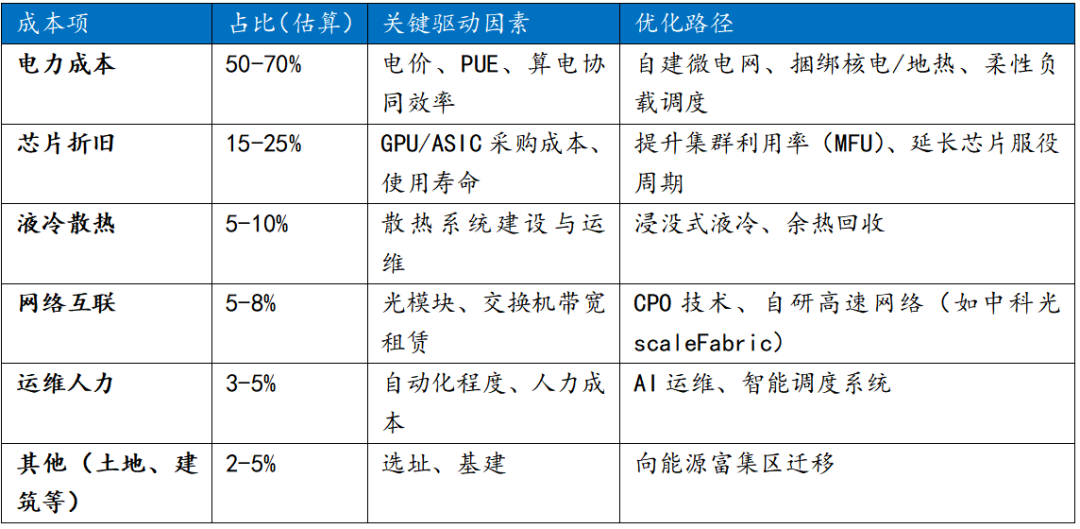

成本构成:Token工厂的运营成本中,电力占比可达50-70%,其次是芯片折旧、液冷散热、网络互联和运维人力。与功耗产出对应,单位Token成本与单位功耗产出成反比——功耗产出越高,单位Token成本越低。

表格8 定价体系:Token作为“智能货币”

数据来源:融中研究

单位成本产出是Token工厂的“利润核心”。在固定功耗下,谁的每瓦Token产出更高,谁的Token成本就更低,谁就能获得更高的利润空间。分级定价体系将Token从技术术语转变为可计价、可交易的商品,使AI服务能够像水电一样按需付费,极大地降低了应用门槛。

3)时间效率

核心指标定义:Token吞吐量(Tokens per second,TPS)、首Token延迟(Time To First Token,TTFT)、每Token生成时间(Time Per Output Token,TPOT)。这些指标直接决定了用户体验和AI系统的可用性。

吞吐量基准(Tokens per Second)

吞吐量是Token工厂在单位时间内能够生成的Token总数,决定了系统能同时服务多少用户请求。

AMD MLPerf突破:2026年4月,AMD在MLPerf Inference v6.0基准测试中首次突破每秒100万Token的吞吐量里程碑,在Llama 2 70B和GPT-OSS-120B等模型上均达到百万级Token/秒的性能。AMD MI355X单GPU在Llama 2 70B上实现100,282 Token/秒,是上一代MI325X的3.1倍。

英伟达Blackwell Ultra:GB300 NVL72的最大单GPU吞吐量达到226.2 Token/秒,比上一代GB200有显著提升。GB300在延迟敏感型工作负载上的性能提升约1.4-1.5倍,延迟改善约1.58倍。

极致案例:字节跳动豆包的日均Token消耗量已达120万亿Token,折合每秒并发处理约13.9亿Token。这已不是实验室压力测试,而是真实生产环境的持续负载,代表了Token工厂吞吐能力的极限边界。

延迟指标(TTFT与TPOT)

首Token延迟(TTFT):从用户发送请求到收到第一个Token的时间。对于交互式应用(如聊天机器人),这是最关键的体验指标。Lambda等厂商通过Smart Expert Routing技术将TTFT的P99延迟降低了31%。

Prefill-Decode分离:英伟达将推理拆分为预填充(Prefill,GPU负责)和解码(Decode,Groq LPU负责),通过分工协作将延迟降至0.1毫秒以下,推理性能提升35倍。

表格9 三大指标的联动关系

数据来源:融中研究

(1)成本结构

表格10 Token工厂成本结构

数据来源:融中研究

电力成本是Token工厂最大的单项支出,占比过半且持续上升。控制Token成本的核心在于提升“每瓦Token产出效率”,而非单纯压降电价。自建微电网、捆绑核电、液冷普及是主要降本手段。

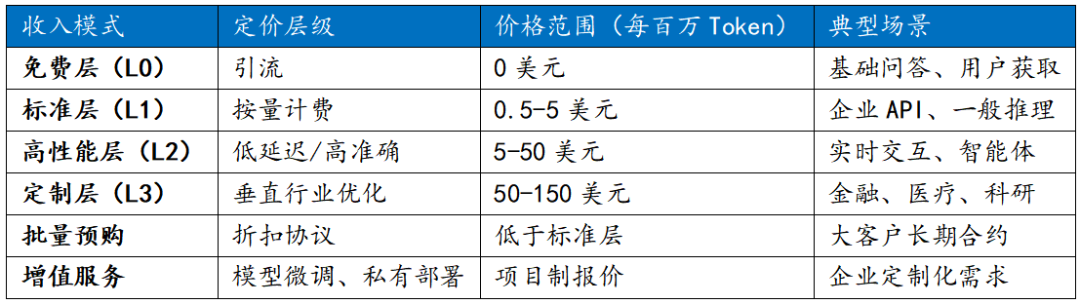

(2)收入模式(定价方式)

表格11 Token工厂收入模式

数据来源:融中研究

Token已成为可计价的“智能货币”,收入模式从单一按量计费走向分层定价。头部云厂商通过涨价(2026年3月涨幅30%-400%)掌握了定价权,市场进入卖方市场。未来收入增长依赖智能体驱动的Token消耗量指数级上升。

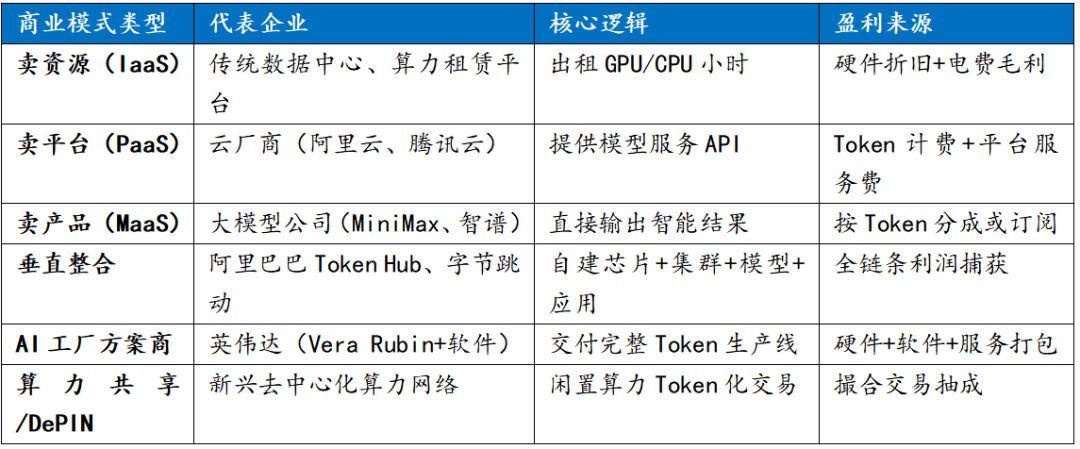

(3)商业模式

表格12 Token工厂商业模式

数据来源:融中研究

Token工厂推动商业模式从“卖资源”向“卖智能”升级,垂直整合成为巨头首选。英伟达从芯片商转型为“AI工厂架构师”,阿里、字节则打通从生产到应用的全链条。未来可能出现专业化的Token生产商与交易平台,进一步细化分工。

Token工厂的经济本质是将电力、芯片、数据转化为可交易的智能商品。成本端以电力为核心瓶颈,收入端依赖Token分层定价与消耗量增长,商业模式正从资源出租走向智能产品交付。三者协同决定了Token工厂的盈利能力和竞争壁垒。

(1)电力供应侧

电力供给侧的挑战:从“成本项”到“产能瓶颈”的质变

Token工厂的电力需求已从传统数据中心的数十兆瓦跃升至数百兆瓦乃至吉瓦级,电力不再是可替代的运营成本,而是决定Token总产量的“硬天花板”。更严峻的是,AI芯片对电压波动极度敏感,而风光绿电的间歇性与Token工厂7×24小时连续生产的要求形成根本矛盾。部分地区电网容量已耗尽,新建Token工厂面临“有GPU、无供电”的尴尬。黄仁勋直言:“数据中心受电力限制,1GW工厂永远不会变成2GW。”电力供给侧正成为制约AI产业扩张的最短木板。

(2)解决方案:算电协同

算电协同的解决方案:从“被动用电”到“柔性共生”

破解电力瓶颈的关键在于让Token工厂与电力系统深度协同,而非单向依赖。一方面,工厂作为“柔性负载”,可根据电网电价和绿电波动动态调整算力分配——电价低时全力训练模型,电价高时仅维持推理服务;另一方面,头部企业正自建微电网,捆绑核电(微软重启三哩岛)、地热(谷歌)等稳定清洁能源,甚至部署小型模块化反应堆(SMR)实现“离网运行”。液冷普及和余热回收进一步提升了能源利用效率,使Token工厂从“电老虎”转型为电网的“调峰伙伴”。

(3)未来趋势

Token工厂未来的发展趋势:从“算力堆砌”到“系统效率”的终极竞争

未来Token工厂的竞争将围绕三大趋势展开:一是推理主导,随着AI智能体爆发,推理算力占比将超60%,低延迟、高吞吐的推理专用芯片(如LPU)和Prefill-Decode分离架构成为新焦点;二是能效为王,每瓦Token产出(Token per Watt)取代峰值算力成为核心KPI,液冷、CPO互联、算电协同等系统级优化决定生死;三是垂直整合与分化并存,巨头自建全链条Token工厂(如阿里ATH),而中小玩家转向专业化分工(算力租赁、Token交易平台)。最终,Token将像水电一样成为普惠智能服务,其生产成本无限逼近物理极限——电力转化效率。

评论