设想一下,倘若我们站在现在这个时间点往后看,重新认识人们在当今生活中对于极致“便利性”、“舒适性”或“观赏性”的追求,可能会惊讶地发现,这些孜孜不倦的苛求,甚至可以说是固执,俨然已令我们养成了对当代科学技术的极度依赖。更有甚者,宛若一个零件嵌入了我们的生活,无法割舍。就像哪一天我们一旦失去了这种依赖,这整个名为社会的存在都恐将溃不成形。

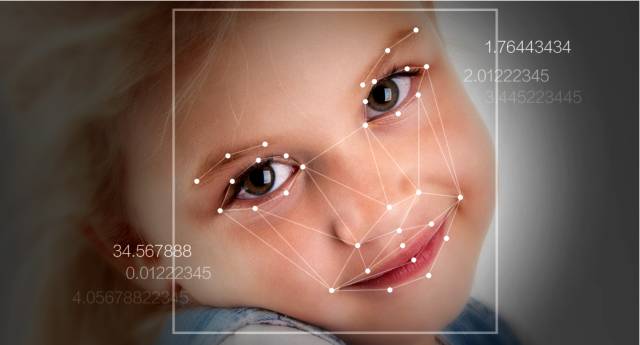

就今天而言,我想把这样一颗零件称为智能化服务,即“能够辨识用户显性和隐性的需求,并提供对应的主动、高效、安全、绿色的服务”。毫无疑问,就像上文所说的那样,从了解、接受变成了依赖,人们已越来越离不开它:新闻媒体基于你的浏览习惯给你推送讯息;视频网站根据你的兴趣爱好向你推荐节目;当你停车的时候不再需要把你的车牌抄下来;当你自拍的时候,软件能自动识别你的五官并加上滤镜;每个iPhone里都配置可以供你调戏的Siri;甚至以后每盏电灯、每个家具都能和你“交流”……

显然,我们已经越来越习惯于智能化服务,甚至觉得智能化已成了科技发展的必然方向,注定是为了服务人类而诞生,发展及进步。然而,若时至今日再让我们去深究其本质便不难发现,不管是通过一个简单的算数模型向你推荐内容(例如根据你网页浏览轨迹来判断兴趣爱好),还是复杂到可以和你有情景化交流的Siri,都是一个计算机系统模拟了人类的学习行为,通过获取新的知识或技能(数据),不断组织已有的知识结构、性能,以至于能“像人一样”做出理解和判断。

“这是最好的时代,也是最坏的时代”,我们早已触碰到了人工智能,但我们也从未真正地触碰过人工智能。

弱人工智能的时代

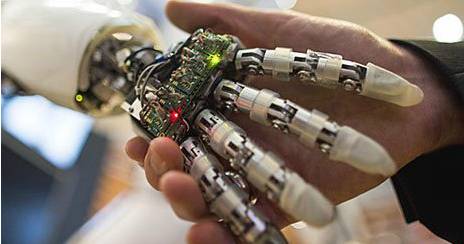

每当提到人工智能,相信很大一部分人联想到的画面会是这样:

1984年,一部《终结者》不仅刷新了当时的电影票房,还成了科幻电影史上具有里程碑意义的史诗级佳作。精彩的剧情,优秀的表演,酷炫的特效成就了这样的一部优质电影。然而除此之外,《终结者》系列还带给了一代又一代人们更终要的回忆以及启发,那便是我们对于人工智能未来的思考。

电影中由人类所创造的具备自我意识的人工智能Skynet(天网),在基于自己的思考和利益下发动了灭绝人类的计划,以至于人类几乎要被覆灭。尽管我们都明白这只是电影中所幻想出来的剧情,但这不由得让越来越多地人开始思考,由我们自己所创造的人工智能是否有一天将会变得和天网一样具备了自我意识并对人类造成危害呢?人工智能的发展,其未来又会往什么方向发展呢?天网模拟了人类的学习行为,不断升级和进化,以至于能“像人一样”做出理解和判断,其本质就和当今任意一个互联网上的智能电影推荐系统一样。而这样随处可见的智能系统将来会有一天诞生完全自主的思维和想法吗?

在继续这个话题前,我门先给读者朋友介绍一组相对概念:弱人工智能,强人工智能以及超人工智能。

首先人工智能本身是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门技术科学。它企图了解智能的实质,并生存出一种新的能以人类智能相似的方式做出反应的智能机器。实际上,早在上世纪中叶,对于人工智能的想法就被西方计算机学家所提出来,并逐渐被作为一门正式的学科得到重视及发展。

然而即便如此,可以说目前对人工智能应用可以说相当原始。就对于上文中所举的例子,如今的语言识别(Siri)、图像识别(照片美化,牌照识别)看上去很“高深莫测”,实际上仍然是基于机器学习算法,基于庞大的数据集,如语料库、图像库训练出来的,这并不是“智能”,而是对人类智能的模拟,我们把这些称作为“弱人工智能”。弱人工智能本质是程序设计者在某种特定的场景下,预测需要做出哪些决策,并通过大数据建立起能进行自我试错,自我学习的算法模型,最终由机器对条件进行考量并给出自己的判断。

对应的,“强人工智能”则是指各方面都能和人类比肩的计算机系统,强人工智能能够进行思考、计划、抽象思维、理解复杂理念、快速学习并从经验中不断优化等操作,是能真正推理(Reasoning)和解决问题(Problem_solving)的智能机器。从某个角度来说,强人工智能就等于人类自身。最后还有一类终极人工智能——超人工智能。简单的来说,超人工智能即是一类能超越人类智慧的人工智能,在几乎所有领域都比最聪明的人类大脑都聪明很多,包括科学创新、通识和社交技能等 …… 就如同Skynet一样,超人工智能总是被同永生和灭绝这两个词联系在一起,这也真是为什么关于人工智能的话题能持续这么火热的缘故。

如何将电脑智能化?

不能发现,即便是现在,我们也是始终处于明显的弱人工智能时代,我们所创造的智能系统仍然无法进行自我思考和自我创新。那我们要如何走完从弱人工智能到强人工智能的变革之路?一般容易被接受的是两点:第一点,增加计算机处理速度。要达到强人工智能,首要的便是要满足计算机的硬件运算能力。现代科学家对人脑计算能力的估计大致是1亿亿cps(一亿亿次计算每秒),人工智能若想发展成具备和人类一样的思考能力,其近似计算速度至少需要和人类保持一致。事实上,当今最强的超级计算机已经超过了这个运算能力,然而巨大的成本以及体积(也许近似一幢楼)导致了这种条件没有可复制性,无法允许更多的人进行试验和探究。

第二点,让电脑变得“智能”,即通过某种手段,如数据堆叠、算法优化,让其运算的逻辑、方式变得和人类生理上的思考方式相一致。:这也是一直以来强人工智能在发展中所遇到的永恒的话题。这里简要地介绍三种我们已知的智能化手段:

1、人脑的计算机模拟

即用计算机架构模拟人脑的工作场景,这边是人工神经网络,它是一个由晶体管作为“神经”组成的网络,晶体管互相链接,有自己的输入和输出系统,而且互相独立。最开始它的神经处理和猜测会是随机的,当它得到正确的回馈后,相关晶体管之间的链接会被加强;如果它得到错误的回馈,连接就会变弱。经过一段时间的测试和回馈后,这个网络自身就会组成一个智能的神经路径,而处理这项任务的能力也得到优化。至今人类已经能模拟大概302个神经元的1毫米长的扁虫大脑,人类的大脑有1000亿个神经元,相差还非常远。

2、模仿生物演化

如果大脑太难完全模拟,那么我们是否可以模拟演化出大脑的过程?这种方法叫做“基因算法”,建立一个反复运作的表现/评价过程,一组电脑将执行各种任务,最成功的将会“繁殖”,把各种的程序融合,产生新的电脑,而不成功的将会被剔除。经过超多次的反复后,这个自然选择的过程将会产生越来越强大的电脑。而这个方法的难点是建立一个自动化的评价和繁殖过程,使得整个流程能够自己运行。

3、让电脑自己解决

总的思路就是我们建造一个能进行两项任务的电脑,在研究人工智能的同事还能修改自己的代码。实际上,这样它就同时又成为了一个电脑工程师,能够边评估自身的性能边改进自己的架构了。我们等于直接把电脑变成电脑科学家,而提高电脑的智能变成电脑自己的任务。

总有一天,我们会造出和人类智能相当的强人工智能,这个时候有一个非常有趣的假设——智能爆炸。一个运行到特定智能水平的强人工智能,有自我改进的机制。当它完成一次自我改进后,它比原来更加聪明了,而后下一次改进时,它的进步将更加明显。如此反复,这个强人工智能越长越快,达到超人工智能的水平,这就是智能爆炸。这个假设就是预计当这种自己我改进机制的强人工智能一旦被达到,则很有可能会在很短时间的即达到超人工智能的水平。

当超人工智能被发明出来以后,我们其实是无法想象它还会什么或者能做什么,或许只有科幻片才能给到我们些许启发吧。纵观历史上的物种变迁,所有物种都将有灭绝的这一天。事实上,迄今为止99%曾经存在过的物种都已经掉下生命的平衡木,故有人担心人类终将会因人工智能走向那一步并不纯粹是杞人忧天。但仍有一部分科学家也认为如果应用得当,超人工智能能帮助人类达到永生。

未来——超人工智能

当超人工智能出现,它会做什么呢,有个非常有趣的猜测。实际上,按照人工智能的定义,他其实只会去完成程序最初设定好的任务。比如我们将超人工智能的初始任务设置为:在卡片上写“我爱人类”,然后尽量多的书写和测试,尽量多的执行,并且不断提高效率和准确性,那么它也只会为了完成这个单一任务而采取他可以采取的手段。甚至到最后消灭人类,他判断的一个结果:消灭人类能有助于他更好完成在卡片上写“我爱人类”这一任务。我们必须指出的是,一个超人工智能是不具备道德性的,并且会努力实现它原本被设定好的目标,而这正是人工智能真正的危险所在了。

而另一方面,超级人工智能也似乎可以解决人类世界的所有问题。气候变暖,超人工智能可以创造更优质的能源生产方式,完全不需要使用石油煤炭,从而停止二氧化碳排放。病毒疾病,也没问题,超人工智能会创造出崭新的药物来克服所有疾病,当人类身体内器官老化,它也会创造出全新的器官给人类替代。粮食问题,超人工智能可以用纳米技术搭建出食物,这些食物在分子结构上是完全和真实食物是相同的。换句话来说,超人工智也可能拥有可以帮助人类达到永生的能力。

然而无论如何,就目前来看,我们完全不用对人工智能技术抱有太多的疑惑和恐惧,人类需要达到真正的强人工智能还需要很久,这个时间可能是我们所想象不到的长。况且随着智能技术的不断发展和完善,互联网的隐私保护、操作安全、最低限度的危机预备技术等都会变得日益成熟以至于像Skynet这样无所不能的人工智能终究只能存在于科幻片中。只不过,当我们能越来越清楚地意识到人工智能的边疆和局限时,我们一定也会抱着更理性也更大胆的心态去挑战这项技术,并旨在为全人类造福。

评论