文|蝉创意

一键美颜一键修图一键还原......

科技发展到现在,好像什么东西都能一键生成。

那“一键脱衣”这种事,你想象过吗?

最近蝉主就看到这样一则新闻,AI用算法“脱掉”女性衣服。

有程序员开发出一款软件,只要提交一张女性照片,软件就能自动“脱掉”女性身上的衣服,生成一张裸体照。

看到新闻详情的时候,蝉主心里真的是一万个问号飘过???

不禁想问,这样的软件开发出来的意义是什么?

借助AI技术,轻易将穿衣服的女性“扒光”

这款可以脱掉女性衣服的软件名为DeepNude。

只要向DeepNude提供一张女性照片,DeepNude就能自动识别移除衣服,生成一张裸照。

DeepNude基于pix2pix开源算法创建,推出之前在超过10000张女性裸体照片的数据集上进行训练。

如此下来,使用软件的人只要轻轻一点,一键就能将带衣服的照片转变为裸照。

当然,裸照也不是免费得到的,该软件分为免费和收费两个版本,免费版本会在处理过的照片上放上大片水印;支付50美元使用收费版本则可去除水印,处理过的照片只会在左上角带有“FAKE”的字样。

不得不承认,带有“色情”的东西传播总是异常的快。

因为美媒的报道,这款软件立马受到大众的关注,无数人涌入网站下载软件,一度导致网站服务器瘫痪。

下载完软件之后,网友也用实际行动拿出照片做“试验”,网上流传出一些明星被“脱掉”衣服后的照片。

有媒体报道,加上网友试验的“效果图”,这个软件如病毒般迅速扩散开来,也开始引起了大众的不满。

不少女性都表示,这样的软件太恶心,随便把女性的照片变成裸照,视女性为玩物。

有人尝试上传男性的照片做试验,结果生成的图片还是女性的形体,也就是说,这个软件的“脱衣”功能只针对女性。

这样的消息出来之后,更多的女性感到不安,她们时刻担心自己的照片会被变成裸照随意散布,害怕自己的隐私被泄露。

网上不满的舆论声越来越多,有媒体对软件的开发者进行了采访,问他为何会开发出这样的软件?

软件开发者Alberto表示,自己曾看过将“白天转换成黑夜”的照片,那时他就萌发将穿衣照片变成裸照的想法。

他利用自己的技能进行了第一次测试,结果真的证实了自己的想法。抱着自己的好奇心,他不断改进该软件的运行算法,最终做出来这个软件。

Alberto强调说:“我不是偷窥者,我只是技术爱好者。”

DeepNude网站截图

在推出软件之前,Alberto也曾想过这样的软件该不该制作出来,会不会伤害到别人的问题。

最终他还是决定推出这个软件,因为他想到用Photoshop也能做到去除衣服的效果,但是要用上好几个小时,如今软件就是缩短了时间。

偏偏“便捷”就是罪恶滋生的开始,越来越多的人前去下载软件,越来越多的人对该软件进行声讨、指责。

在舆论的压力下,最终DeepNude的创建人宣布关闭该应用程序。

DeepNude在推特上发布了关闭软件的声明,软件创建人说自己低估了人们对软件的兴趣,鉴于软件被滥用的可能性太大,决定下架该软件。

AI换脸到AI脱衣,没人知道技术会被怎么利用

看到AI脱衣事情,相信很多人都会想到之前大火的AI换脸。

AI换脸技术比AI脱衣红得更早,之前因为不同明星的脸换到不同剧情里还上过几次热搜。

杨幂朱茵换脸。

寡姐变成佟湘玉。

鹿晗版小龙女。

这些换脸视频最早在微博上传播的时候,大家都当看乐子般一笑而过。

后来有网友提醒这样的行为其实侵犯了明星的肖像权,一度也引起了纷争。

还有闲着没事的粉丝将换脸前后的明星做比较,在评论里引发骂战,争议不断。

不过,拿AI换脸将明星换到不同剧情里,还算不上恶俗。

真正恶俗的,是有人用AI换脸将女明星的脸换到色情影片中去。

AI换脸最早被大众知道,就是有人在国外论坛上发布了AI换脸后的女明星色情影片。

盖尔·加朵的脸被换到色情影片中

虚假色情影片的传播太快,论坛为降低影响关闭了这个讨论组。

可是关闭得了讨论组,关闭不了大众想讨论的心。

在那之后,不断有女明星被AI技术换脸到色情影片里,国内国外的女星都备受困扰。

寡姐斯嘉丽·约翰逊在接受采访时就曾怒斥用人工智能制造色情内容的行为,她说这些不雅视频对她造成极大的困扰。

可是除了训斥斯嘉丽也别无他法,斯嘉丽的团队表示,她们根本控制不了虚假色情影片的制造和传播。

千万不要以为只是女明星才会遭受此劫难,也有人将自己的同学朋友换脸到色情影片中。

除了利用AI换脸技术意淫女明星,国外也经常拿AI换脸技术恶搞政客。

特朗普化身美国队长。

人工智能合成产生的奥巴马演讲视频。

有人模仿特朗普,最后被AI技术将脸换成特朗普。

这些换脸与合成视频,有些轻易就能看出是假的,被当成了一种娱乐,也有些以假乱真,对当事人造成了影响。

美国众议院议长南希·佩洛西的视频曾遭遇网友的恶搞,网友将她说话的语速降低,使之表现得很像是醉了酒。

该恶搞视频在网络上传播之后,南希·佩洛西遭受到不少“醉酒后胡言乱语”的无端指责。

从前AI换脸技术是有正面价值的,运用到电影电视行业里,明显为实用的技术。

后来发展成为网友换脸不同明星到不同剧集里,有些时候网友也是好奇没有恶意。

可当AI换脸技术把女星的脸换到色情影片里,或利用换脸技术恶搞丑化他人,那就找不出任何理由为AI换脸技术开脱了。

随着科技的发展,人们的随意利用,如今AI换脸技术慢慢变成了制造假消息、假色情影片的工具。

在网络时代,这些虚假的消息和视频又都难以被删除或遏制住,最终技术成为了罪恶的帮凶。

AI工具有阴暗面,技术无罪但人心难测

从AI换脸到AI脱衣,科技到底被如何利用真是难以想象。

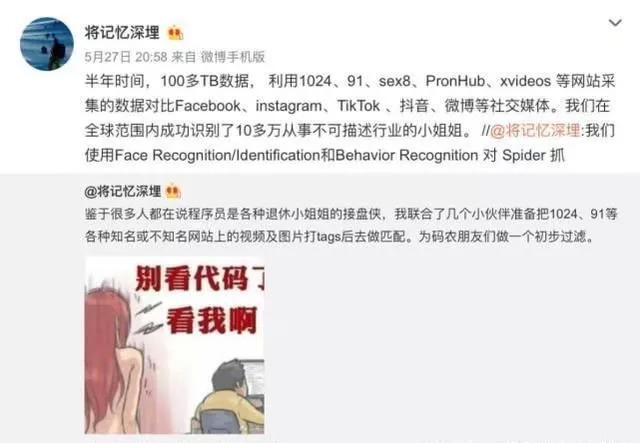

前阵子还有技术宅开发出一个名为“原谅宝”的软件,意在帮男性老实人鉴别“渣女”。

软件开发者说,因为很多人说程序员是各种退休小姐姐的接盘侠,所以他想开发这个软件,通过人脸识别来鉴别私生活混乱的女生,避免程序员成为接盘侠。

这样的话说出来,男生为他点赞,女生们就惶恐不安了。

对软件表达反对的女性还在网络上遭到网友的攻击,网友恶语相向说:“我们针对生活不检点的女生,不针对好女生。”

这样的话实在很可笑,这款软件的存在,不管有没有人去利用识别,本身就已经是对女性的不公平和针对。

由于网上对这个软件的争议太大,最终软件开发者宣布不会推出该软件。

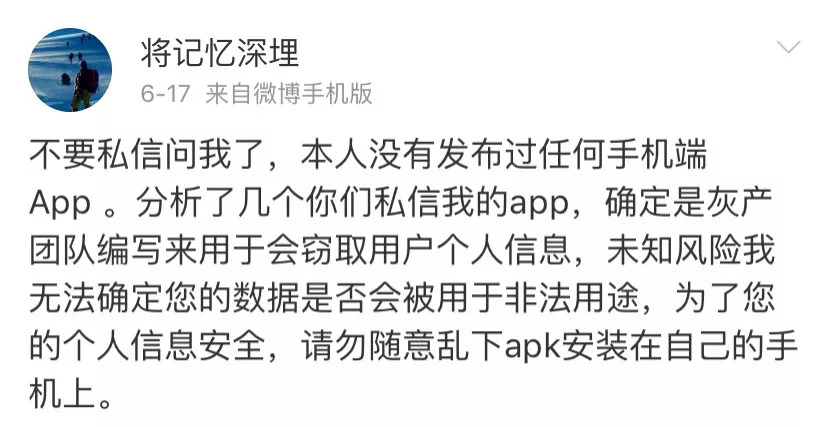

然而,“原谅宝”这件事并没有因此结束。

不久之后,一款名为“原谅宝”的APP在各大手机应用商店里,在微博也有了官方账号。

很多人上赶着去下载体验,图好玩或者想鉴定自己的女朋友,最后只是白白交了智商税。

事后,最先发出“原谅宝”消息的博主在微博澄清,市面上的原谅宝APP与他毫无关系。

每次聊到科技被利用做坏事的时候,很多人都会出来说,科技无罪。

的确,科技无罪,可是人心太难测。

没人知道,开发这个软件的人最初抱着什么心态,没人会知道这个软件最后会被怎样的人利用。

当科技发展的情况与人类道德观不相匹配的时候,总有人成为受害者。

更让人难过的是,明知软件或视频是伤害他人的产物,依旧有人想利用这些软件,传播这些视频。

Deep Nude宣布关闭之后,网上有不少人开始求分享软件副本。

AI换脸的色情视频被网站下架之后,私下还有人在传播,或自己制作色情视频。

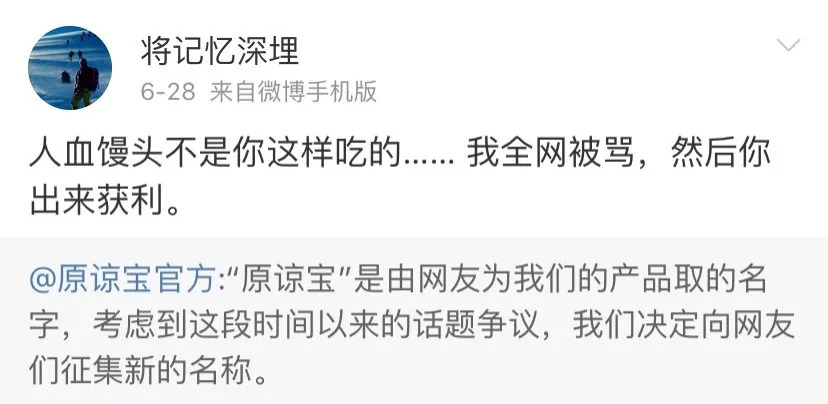

开发“原谅宝”的博主被骂停止了软件开发,有人利用“原谅宝”的名字,写个程序做个APP就出来骗钱。

“原谅宝”开发者指责新软件开发者吃“人血馒头”

开发软件的是人,使用软件的是人,人无法限制科技的发展,可是人能决定科技结果最终的走向和影响。

DeepNude软件的创始人在关闭软件时说:“这个世界还没准备好Deep Nude的出现。”

这个世界可以接受科技的高速发展,但人心还没准备好在不同科技面前不动坏心思。

在高速发展的技术面前,最为可怕的始终还是人心。

【未经许可 | 禁止转载】

来源:蝉创意

评论