文|VR陀螺

如何让AR/VR设备更易于让消费者接受一直是各大厂商需要应对的问题,除了价格外,设备的舒适度、功能和效果都是消费者很看重的因素。而当前市场上的设备大部分从外形上来看都较为笨重,也并不适合长时间佩戴。从视觉效果来说,越好的设备就需要越强的运算能力并消耗更大的电量,这也就意味着设备在外形设计上处处受制。那么该如何降低设备功耗,令设备可以更加轻便的同时又不影响图像质量?

为此,Facebook的研究部门Facebook Reality Labs基于神经网络开发了一款名为DeepFovea的图形渲染系统,以应对这个挑战。以下是Facebook在其博客上发表的完整文章:

在Facebook Reality Labs,我们正在建立一个未来,让现实世界和虚拟世界可以自由地混合在一起,使我们的日常生活更轻松,生产力更高,并相互连接在一起。功耗是实现该未来的挑战之一。为了获得可以在任意长时间(包括整天)内舒适佩戴的增强现实和虚拟现实(AR / VR)设备,VR头戴设备都必须具有更高的能效,而AR眼镜必须消耗较少的电量。作为构建达到更高级别的AR / VR系统的一部分,我们正在开发可显着降低功耗而又不影响图像质量的图形系统。

DeepFovea是我们为应对这一挑战而开发的几种基于神经网络的方法之一。DeepFovea是一种渲染系统,它应用了最近发明的AI生成对抗网络(GAN)概念,以模仿我们的外围视觉在日常生活中感知世界的方式,并利用可感知匹配的架构来提供前所未有的图形效率。

DeepFovea的神经渲染远远超出了当今Oculus产品中使用的传统的凹版渲染系统,从而可以生成与全分辨率图像在视觉上无法区分的图像,而渲染的像素数却不到10%。现有的集中式渲染方法需要渲染的像素大约是全分辨率图像的一半,因此DeepFovea降低渲染要求的数量级代表了感知渲染的新里程碑。

我们首先在2019年11月的SIGGRAPH Asia上展示了DeepFovea。今天,我们将完整的演示发布到我们的DeepFovea存储库中,以帮助图形研究社区加深对最新感知渲染的探索。

DeepFovea:以AI为动力的外围视觉建模

DeepFovea的关键是利用人眼的生理功能。当人们的眼睛直接看着物体时,来自该物体的光子会落在视网膜的中央凹区域,简称中央凹。中央凹是视网膜中唯一具有高分辨率的部分,并且它仅占整个视网膜中很小一部分。在人眼超过150度的视野中,最高分辨率的区域仅跨越3度,在距中央凹中心10度以内的分辨率下降了一个数量级。我们觉得我们拥有更广阔的高分辨率视野,但这是因为我们的大脑保存了周围环境的模型并填充了缺失的细节,同时又将中央凹迅速移至我们任何感兴趣的对象上。实际上,我们只有一个很小的高分辨率视野区域,而对围绕它的一切事物的感知却非常模糊。

但这并不是说外围视觉并不重要。外围视觉对于平衡、运动检测和周围环境感知非常重要,并可以提示大脑下一步该去哪里。但是它区分细节的能力受到极大限制。

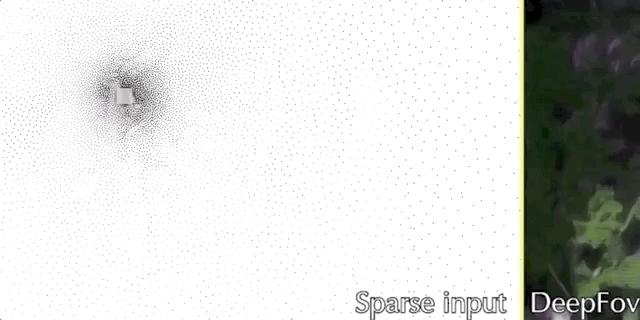

DeepFovea使用最少的必要数据量来生成与视网膜分辨率匹配的图像。给定一个稀疏渲染的图像,其可变分辨率与在任何给定时刻指向中央凹的位置的每个点处的视网膜分辨率相匹配,DeepFovea会推断丢失的数据。至关重要的是,在给定视网膜的分辨率和图像处理特性的情况下,所产生的结果在感觉上与全分辨率图像没有区别。但这并不意味着结果是相同的-实际上,如在下例中看到的那样,当人们使用中央凹观察时,所看到的图像与全分辨率图像通常并不接近-但外围视觉的较低分辨率处理可以让人察觉不到差异。

DeepFovea通过使用生成对抗网络(GAN)推断丢失的外围信息。我们通过提供数百万个具有人为降低的外围质量的真实视频来训练DeepFovea的神经网络。人工降级的视频模拟了外围图像的降级,基于GAN的设计可帮助网络根据所看到的所有视频的统计信息来学习如何填充缺失的细节。

结果,渲染器可以少渲染几个数量级的像素,甚至更少——像素密度可以在60×40度视场的外围减少多达99%的像素,从而节省了大量的时间功耗。得益于DeepFovea和眼动追踪技术,观看者才能以完全相同的质量感知完全相同的场景。

DeepFovea还可以确保人眼不会察觉到周围的闪烁,混叠和其他视频伪像。

此动图演示了DeepFovea如何在头显设备佩戴者的注视(由光标表示)下,在场景中的元素之间移动时重建偏心的视觉效果。观察输入像素的数量如何远离中心视觉区域减少,从而匹配视网膜的分辨率,然后DeepFovea如何在像素落在视网膜外围区域的情况下以与全分辨率呈现的像素不同,但在感知上却相同的方式重建图像,且最终效果与理想图像无法区分。

未来是光明且高效的

我们的最终目标是使实时集中式渲染在轻便、高能效的AR / VR设备上运行,该设备可以让用户整天佩戴。DeepFovea建立了新的感知渲染效率标准,这标志着朝向该目标迈出的重要一步,该方法证明了感知的质量损失,同时渲染的像素数不到传统渲染器的10%。这种方法也与硬件无关,这使DeepFovea能够与各种AR / VR研究系统兼容。

尽管DeepFovea解锁了在AR和VR中进行有效渲染的重要方法,但这仅仅是探索超低功耗感知渲染的开始。通过发布除我们的研究论文外的DeepFovea演示,我们希望为有兴趣为感知和神经渲染技术的发展做出贡献的图形和视觉科学研究人员提供一个有用的框架。

原文链接:

https://research.fb.com/blog/2020/05/deepfovea-ar-vr-rendering-inspired-by-human-vision/

评论