曾以为自动驾驶会让出行更安全,可当自动驾驶汽车进入真实的交通环境后,却一再引发恶性事故。Why?

两个月前“Uber自动驾驶车撞人致死事件”一度成为刷屏级热点,将来甚至有望被载入自动驾驶汽车发展的“史册”。

但鉴于对事件本身的解析早已铺天盖地,此处便不再赘述。唯一要补充的是,在当时的交通环境下,即便是奥迪、奔驰等汽车厂商尚在打磨中的L5级自动驾驶车,又或者是Waymo、Mobileye等无人车技术供应商研发的自动驾驶车,要是随车安全员未能及时发现险情,很可能也会发生恶性交通事故。

严格来讲,这些车辆的自动驾驶系统,在眼下都还无法从容应对真实交通环境。

除了识别,还要懂预判

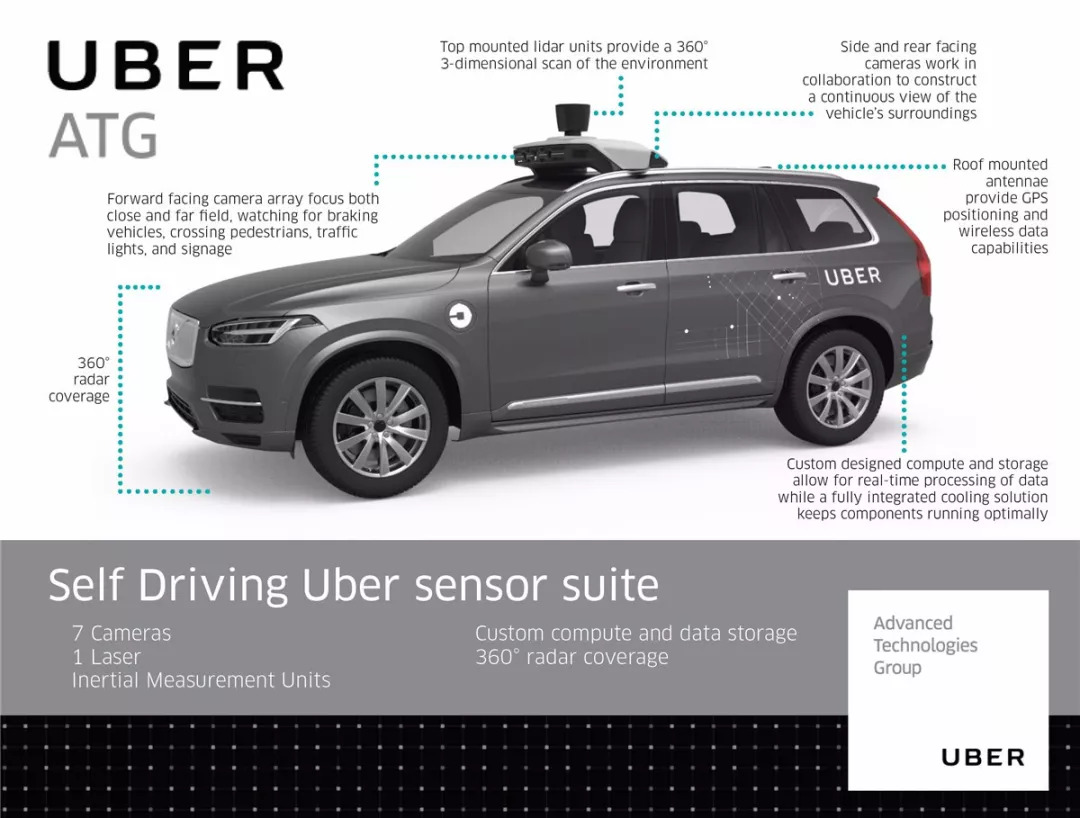

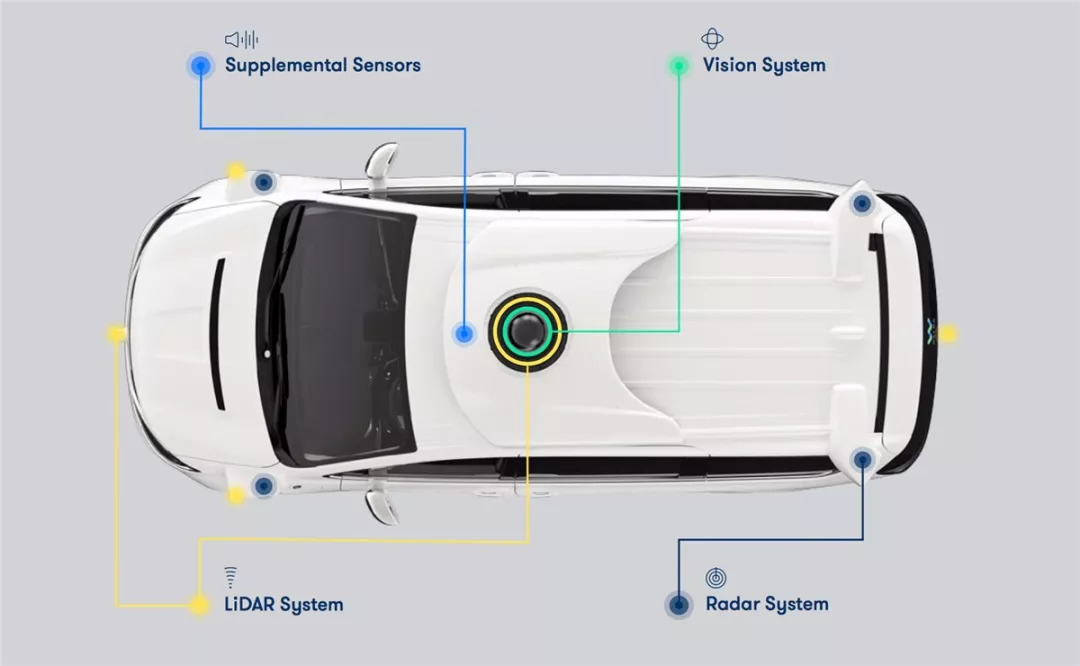

众所周知,L3级别以上的自动驾驶系统一般都会通过传感器、处理器和高精度地图三大系统共同合作来实现对车辆的控制,要想避免交通意外,传感器与处理器的性能尤为重要。

但不幸的是,目前最常用的三大传感系统——摄像头、微波雷达、激光雷达都还存在着短板。

三大传感系统:

Vision System摄像头

Radar System微波雷达

LiDAR System激光雷达

其中,摄像头会由于镜头被污染或图像传感器品质欠佳,而使整个图像传感系统失效,进而导致自动驾驶系统“瞎眼”;微波雷达则可能因为频谱带宽偏窄而令自动驾驶系统在光照条件较差时,得不到足够好的空间分辨率以及目标识别能力;至于车载激光雷达,因制造成本所限,用不起性能优异但昂贵的工业或军用装备,以至于有效识别距离通常不超过200米,遇到雨雪、雾霾等恶劣天气,识别率还会大幅下降。

而对于现行自动驾驶系统的中央处理器,则亟待完善相应的算法。

简单来讲,首先人类要尽快教会电脑从庞大的传感器数据流里头,识别出更多现实世界中的物体。

就拿这次的Uber事件来说,受害者是一名推着自行车的行人,但直到2013年,量产车才首度拥有支持自行车检测的AEB自动紧急刹车系统。

自行车与行人的运动轨迹,有很大的不可测性。2013年日内瓦车展,才由沃尔沃发布首款可用于量产车,并能“捕捉”自行车与行人的AEB自动紧急刹车系统。

就连自动驾驶技术的先行者谷歌,也迟至2016年才搞定自行车识别技术,并于2017年带来针对自行车的传感器技术。

自动驾驶汽车公司Waymo源自谷歌

也在实地测试自动驾驶系统

显然,若是碰到智障处理器,传感器再智能也无用,这套自动驾驶系统已是不可救药的次品。

其次,光会识别还不够,还得预测到障碍物的下一步行动,正如人类要有良好的预判能力,才能有效避免交通意外的发生一样,真正合格的自动驾驶系统也必需能做到这点,不然在安全员的“陪护”下行驶再多的“零事故”里程亦枉然,独立上路后照样会在真实环境中发生交通意外,甚至可能出现比Uber事件更严重的惨案。

然而,各大智能自动驾驶系统至今仍未攻克这一关,还在大量地进行实地模拟和仿真测试,以便积累更多处理实际场景的数据。

由此可见,现有的自动驾驶系统既没有无懈可击的硬件,也不具备足够智能的软件以独立应对复杂的真实交通环境。

在严格控制的条件下得到的漂亮数据其实都是皇帝的外衣,只不过,这回Uber恰好是那位诚实的小孩而已。

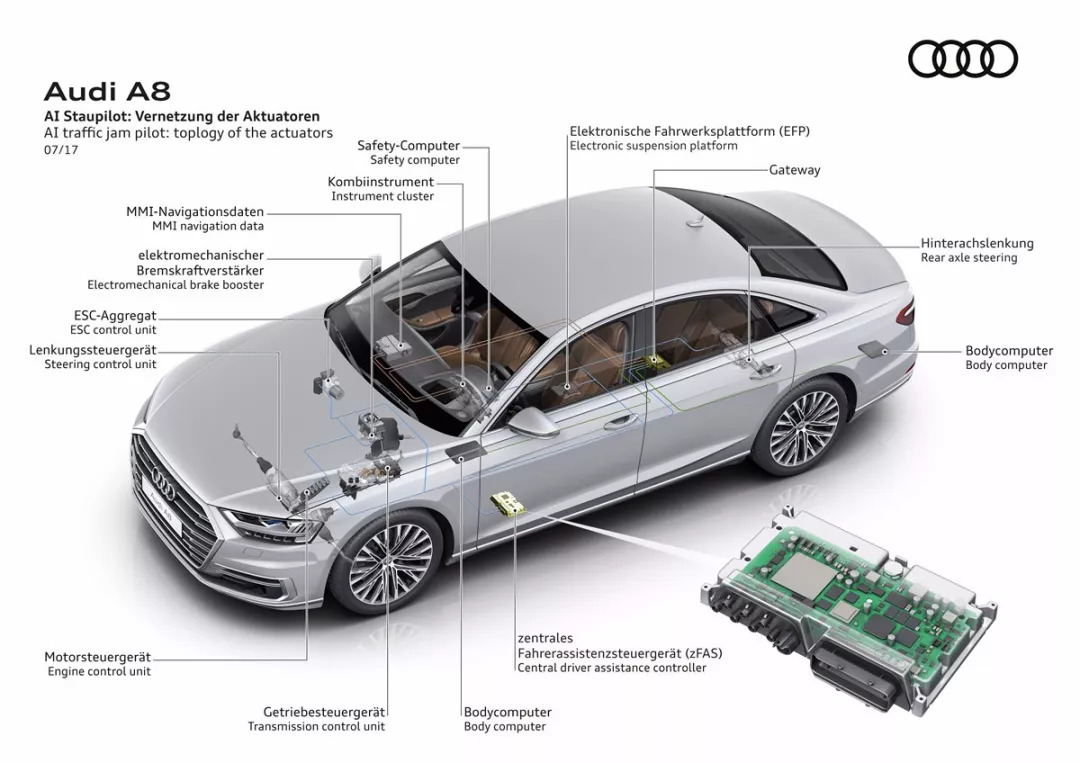

最新一代奥迪A8

是首款实现L3级自动驾驶的量产车

即使将来智能系统真正学会如何开车上路,也依然无法完全杜绝意外的发生。因为,只要交通环境是开放的,就始终存在着智能系统难以感知或者识别困难的偶然因素。

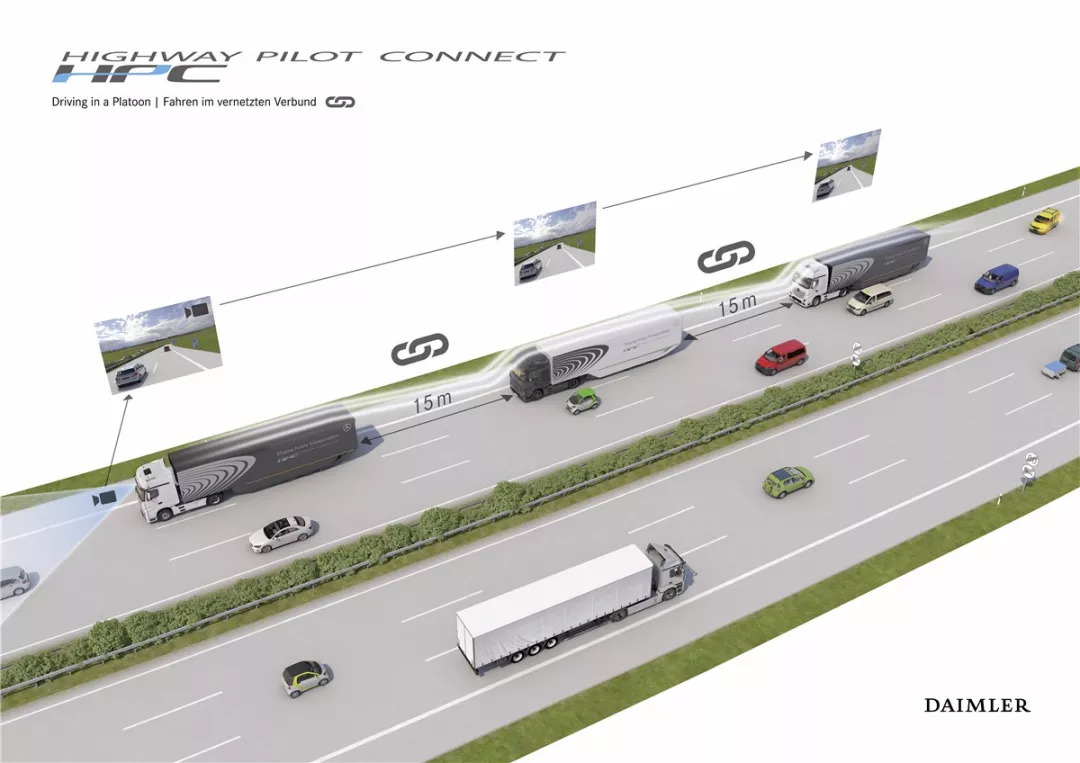

除非将交通网络封闭起来,或者让车辆的“触角”覆盖整个空间,不然,意外必将发生。

戴姆勒-奔驰的自动驾驶卡车

可实现编队行驶

自动驾驶系统面对交通意外时的无能为力固然令人失望,但从畜力车到汽车,“懒惰”的人类其实一直在寻求更加高效、省力的移动方式。

因此,一般人早晚会厌弃要手脚并用且需注意力高度集中的驾驶操作,而把它交由智能系统来代劳。如无意外,自动驾驶汽车必将成为未来的主要交通工具。

其实,人工驾驶的传统汽车在刚诞生时,同样如洪水猛兽般伤人无数,但人类还是选择更便捷的汽车,并努力“驯化”它,使其愈发安全可靠。

所以,不必因为有限的个案而彻底否定自动驾驶系统带来的便利。相反,应当让更多通过模拟测试的产品进入真实环境,以检验测试成果,并继续优化,进而降低发生交通事故的几率。

一直呆在“温室”里,自动驾驶系统永远不会实用化。

不过,正如Uber测试车所展示的那样,幼稚的自动驾驶系统会犯下致命的错误。因此,当更多测试车进入真实的交通环境后,对于必将上涨的事故发生几率要做好充分的思想准备,并且相信厂商会吸取教训,再带回更安全的产品。

这是成长的代价,除非人类决定远离100%自动驾驶汽车,但这就好像你教小孩时为了怕他摔倒而不让他练习走路一般,不太可能!

附:自动驾驶汽车常用传感器的主要问题

1.视频影像

其实,当前主流自动驾驶系统所用的摄像头从镜头、图像传感器到图像处理器都已经具备足以应对常见应用场景的性能,将来还可能用上集成镜头、图像传感器和图像处理器,以及画面像素至少1920×1080、成像动态范围在140dB以上的高清摄像头。

不过,再高清的摄像头也无法消除物理遮挡、污渍等外界因素的影响。

故而,一套完善的自动驾驶系统必须在摄像头之外,再辅以雷达、红外光等其他传感器。

2.毫米波雷达

目前,根据无线电主管部门对车载雷达频率的划分,国内的量产车只允许使用24GHz和77GHz两个频率,其中24GHz主要用于后侧向的近程探测,而77GHz多用于前向远程探测。

从实际使用的效果来看,这两个频率也算够用,但频谱专家认为要满足L3级以上自动驾驶系统的需求,应像欧盟那样开放79GHz频段,这样车载雷达就有7GHz的带宽,远高于77GHz的1GHz带宽,从而获得更好的目标识别能力以及空间分辨率。

3.激光雷达

实际上,如今激光雷达的问题并不在于技术,而是成本。体积不大的军用激光雷达辨识距离超过300米,并能在雨雪天气下正常工作,可售价据说要千万美元。

而在民用领域,老牌激光雷达厂商Velodyne的VLP-16型360°可动激光雷达,激光头可射出16束光线,辨识距离达到100米,并可在1秒内扫描30万个检测点,出厂价远比军用产品便宜,但也在7000美元以上。

更便宜的也有:德尔福投资的Quanergy公司推出之S3型固态激光雷达传感器,体积小到可嵌入车体,并能输出3D图像,单个成本只要100~200美元,可才8束光线,探测距离仅有10厘米到150米,而扫描频率则为30Hz。

然而,未来自动驾驶汽车需要的是:能在复杂气象条件下使用,最大探测距离在200米左右,拥有32束以上光线,并可嵌入车体的量产商品。

评论